16,99 €

Niedrigster Preis in 30 Tagen: 16,99 €

Niedrigster Preis in 30 Tagen: 16,99 €

Mehr erfahren.

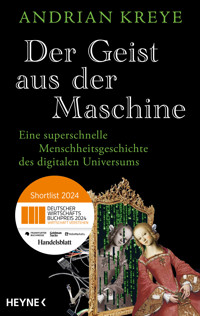

- Herausgeber: Heyne Verlag

- Kategorie: Wissenschaft und neue Technologien

- Sprache: Deutsch

Welche Zukunft hat der Mensch im digitalen Universum?

Noch nie hat sich ein entscheidendes Kapitel der Menschheitsgeschichte so schnell vollzogen wie die digitale Revolution. Der renommierte Kulturjournalist Andrian Kreye hat den Aufstieg der digitalen Technologien von einer Subkultur der Programmierer, Wissenschaftler und utopischen Denker in den 1980er-Jahren zur kulturellen, sozialen und politischen Superkraft der Gegenwart genau verfolgt. Die Geschichte der digitalen Revolution beschreibt er nicht nur als Chronist eines Kulturwandels, sondern auch als Augenzeuge aus dem Blickwinkel des politischen Reporters.

Ein spannendes und wichtiges Buch für das Heute an der Schwelle zu einem neuen digitalen Zeitalter.

Das E-Book können Sie in Legimi-Apps oder einer beliebigen App lesen, die das folgende Format unterstützen:

Seitenzahl: 466

Veröffentlichungsjahr: 2024

Ähnliche

ANDRIAN KREYE

Der Geist aus der Maschine

Eine superschnelle Menschheitsgeschichte des digitalen Universums

Der Inhalt dieses E-Books ist urheberrechtlich geschützt und enthält technische Sicherungsmaßnahmen gegen unbefugte Nutzung. Die Entfernung dieser Sicherung sowie die Nutzung durch unbefugte Verarbeitung, Vervielfältigung, Verbreitung oder öffentliche Zugänglichmachung, insbesondere in elektronischer Form, ist untersagt und kann straf- und zivilrechtliche Sanktionen nach sich ziehen.Der Verlag behält sich die Verwertung der urheberrechtlich geschützten Inhalte dieses Werkes für Zwecke des Text- und Data-Minings nach § 44 b UrhG ausdrücklich vor. Jegliche unbefugte Nutzung ist hiermit ausgeschlossen.

Originalausgabe 2024

Copyright © 2024 by Wilhelm Heyne Verlag, München,

in der Penguin Random House Verlagsgruppe GmbH,

Neumarkter Straße 28, 81673 München

Umschlaggestaltung: SERIFA, Christian Otto

unter Verwendung einer Illustration von © Stefan Dimitrov

Satz: Uhl + Massopust, Aalen

ISBN 978-3-641-31279-4V001

www.heyne.de

Für Henri und Karl, die in einer Welt aufwachsen, in der vieles schon selbstverständlich ist, was gerade noch eine Revolution war.

»Die grundlegende Tatsache der Computernutzung bleibt aber ›Müll rein, Müll raus‹.«

Stewart Brand, 1972

»Das Internet ist eine außerirdische Lebensform.«

David Bowie, 1999

»Ich denke, dass die Diskussion über diese Technologie viel klarer wird, wenn wir den Begriff künstliche Intelligenz durch das Wort ›Automatisierung‹ ersetzen.«

Emily Bender, 2023

Inhalt

Vorwort

1. Kapitel – Jäger und Sammler

Wie der Mauerfall den Aufstieg der digitalen Gesellschaft auslöste und sie in einem Forschungslabor am Massachusetts Institute of Technology die Menschheit neu sortierten.

2. Kapitel – Die digitale Antike

Als die Subkultur in der einstigen Hippiehochburg San Francisco ihre E-Gitarren gegen Mac-Rechner tauschte und eine Vision für das Internet entwarf, zu der auch das erste soziale Netzwerk im Netz gehörte.

3. Kapitel – Aufstieg zum Weltreich

Wie zwei junge Außenseiter aus dem amerikanischen Süden das Weiße Haus eroberten und dort das Fundament der digitalen Gesellschaft mit Gesetzen zementierten.

4. Kapitel – Das Mittelalter

Wie ein Code aus Genf die Pforte zur digitalen Wahrnehmung aufstieß und jeder mit ein paar Hundert Millionen Menschen gleichzeitig ins Gespräch kommen konnte. Zumindest theoretisch.

5. Kapitel – Die Renaissance

Wie ein Kreis neuartiger Intellektueller eine Revolution anzettelte, die das Denken und die Welt für immer veränderte.

6. Kapitel – Die Aufklärung

Wie sie an der amerikanischen Westküste erst das Internet und dann das neue Denken ordneten und dabei die antike Figur des Orators ins Zentrum des Geisteslebens zurückkehrte.

7. Kapitel – Die industrielle Revolution

Wie das Internet seinen Siegeszug über die Bequemlichkeit der Menschen antrat und sich ein Hedgefonds-Manager aus New York die Schwäche des Buchmarktes zunutze machte, um ein Weltreich aufzubauen.

8. Kapitel – Die Räuberbarone

Wie die Pioniere der digitalen Industrie nach der Eroberung des Cyberspace nach neuen Grenzen suchten und sie dann im Weltall fanden.

9. Kapitel – Der Kolonialismus

Wie Deutschland die neue künstliche Intelligenz erfand und warum es seine Rolle als Nummer zwei der digitalen Welt schon so früh verspielte.

10. Kapitel – Hass und Hetze

Wie das Internet die Köpfe und Herzen der Menschen eroberte, warum sich Lügen, Hass und Hetze im Netz so viel schneller ausbreiten als Wahrheiten und Freundlichkeit, und warum das schon seit den Achtzigerjahren so ist.

11. Kapitel – Die Automatisierung

Wie sich die Debatte um künstliche Intelligenz schon zwanzig Jahre vor dem Boom der Denkmaschinen in die beiden Lager der Euphoriker und Apokalyptiker teilte und dabei religiöse Züge annahm, die sie nie wieder ablegte.

12. Kapitel – Aufstand der Massen

Wie das Internet im Nahen Osten und der arabischen Welt für kurze Zeit sein Versprechen als Motor der Demokratisierung einlöste und warum Donald Trump genau damit zum Präsidenten wurde.

13. Kapitel – Nazis

Wie ein Ku-Klux-Klan-Anführer in Florida die Grundlagen für den Hass im Netz schuf und warum er mehr Macht und Einfluss auf die Geschichte des Internets hatte, als man glauben mag.

14. Kapitel – Sabotage

Wie ein Hacker aus dem australischen Bildungsbürgertum die Mächtigen der Welt in Bedrängnis brachte und damit den Journalismus revolutionierte.

15. Kapitel – Die Arbeiterbewegung

Wie die Digitalkonzerne den Menschen Abhängigkeit und Ablenkung als Zukunft und Rebellion verkauften, bis die Leute genug hatten und sich zur Gegenbewegung des Techlash formierten.

16. Kapitel – Panoptikum

Wie die digitale Welt zu einer Überwachungsmaschine wurde und wie eine kleine Firma aus London diese Mechanismen im Auftrag von Donald Trump dazu benutzte, die US-Wahlen zu kapern.

17. Kapitel – Nationenbildung

Wie schwer sich eine Firma wie Facebook damit tut, sich zu definieren, wenn zu ihr mit drei Milliarden Abonnenten mehr Menschen gehören als zu jedem Nationalstaat und jeder Weltreligion.

18. Kapitel – Die Facebook-Papiere

Wie eine Whistleblowerin entlarvte, dass Mark Zuckerberg mit Facebook eine Höllenmaschine gebaut hatte, über die er längst die Kontrolle verloren hat.

19. Kapitel – Aufruf zum Völkermord

Wie die Dynamik in den Algorithmen bei Facebook in Südostasien einen Genozid anfeuerte und warum eine Klage der Opfer das Rechtsverständnis des digitalen Raums verändern könnte.

20. Kapitel – Rechtsruck der Supermacht

Wie Elon Musk vom Autobauer zum reichsten Mann der Welt aufstieg, das Zentralorgan der globalen Meinungsmacher kaperte und für die Lager der Extreme öffnete.

21. Kapitel – KI weltweit

Wie die künstliche Intelligenz aus den Nischen der Forschung auf die Weltbühne trat und der Weltmeister im Brettspiel Go als Erster der KI als Wesen begegnete.

22. Kapitel – Der iPhone-Moment

Wie KI aus der Maschine in den Alltag sprang und die nächste Phase der Digitalisierung der Gesellschaft begann.

23. Kapitel – Superintelligenz

Wie KI zum neuen Betriebssystem der Welt wurde, obwohl sie dabei viel Blödsinn produzierte.

24. Kapitel – Supernova

Wie künstliche Intelligenz Gefühle erkennt, der Machtkampf um die Kontrolle der KI beginnt und sich Europa zum Zentrum eines digitalen Humanismus erklärt.

Quellen

Dank

Vorwort

Wann genau hat sich mein Leben in einen Science-Fiction-Roman verwandelt? Während ich an diesem Vorwort arbeite, bereite ich gerade eine Reise in die Schweiz vor, wo Wissenschaftler in einem Labor am Genfer See eine künstliche Intelligenz entwickeln, die nicht mehr auf einem neuronalen Netz aus Siliziumchips läuft, sondern auf einem Netz aus menschlichen Zellen. Später werde ich einen Professor in München besuchen, der in seinem Labor synthetische DNA herstellt, die in Zukunft Chips und Festplatten als Speichermedien ersetzen soll. In Amerika feilschen sie unterdessen darum, das komplette Weltwissen jetzt und für alle Zukunft in KIs einzuspeichern. All dies soll die Entwicklung beschleunigen, die im Herbst des Jahres 2022 damit begann, dass ein paar Programmierer des Start-ups OpenAI in San Francisco beschlossen, ihre künstliche Intelligenz namens ChatGPT auf die Menschheit loszulassen.

Sie waren nicht die Einzigen, die solche KIs konstruiert hatten, mit denen man sich erstmals unterhalten konnte wie mit einem Menschen. Sie waren nur die Einzigen, die sich nicht darum scherten, dass diese Programme eigentlich noch nicht ausgereift genug waren, um sie in Massen zu verbreiten. So springt künstliche Intelligenz gerade aus den Maschinen ins Leben der Menschen. Vorbei die Zeiten, als KI sicher hinter den Glasscheiben von Monitoren und Touchscreens verwahrt war. Sie hat begonnen, in jeden Winkel des menschlichen Lebens vorzudringen, bis in die Köpfe hinein. Sie kann nun vor allem selbstständig handeln.

Die Menschen haben davor Angst. Fast die Hälfte aller Deutschen fürchten sich vor künstlicher Intelligenz. In Amerika sind es sogar mehr als die Hälfte der Menschen. Tendenz steigend, vor drei Jahren waren es nur ein Drittel. Diese Ängste haben wenig mit Science-Fiction zu tun, auch wenn einige Pioniere der KI Horrorszenarien vom Ende der Menschheit und der Welt entwerfen, als sei künstliche Intelligenz keine Technologie, sondern ein Monster, ein Meteorit oder eine Massenvernichtungswaffe. Das Ende der Menschheit oder der Welt ist allerdings die geringste Sorge, die KI den Menschen bereitet. Es sind konkrete Ängste, wenn man die Untersuchungen zum Beispiel des Bayerischen Forschungsinstituts für digitale Transformation oder des Meinungsforschungsinstituts Pew Research Center liest. Das ist die Furcht vor Kontrollverlust, vor dem Verlust des Arbeitsplatzes und vor der Verstärkung gesellschaftlicher Ungerechtigkeiten, es sind die Ängste vor Falschnachrichten, vor Angriffen mit digitalen und vor dem Einsatz autonomer Waffen. Das sind berechtigte Befürchtungen, weil digitale Technologien all diese Probleme schon länger verstärken. Diese Ängste sind aber auch Symptome eines Zukunftsschocks, wie ihn Soziologen und Futuristen in den 1970er-Jahren schon einmal diagnostizierten, als sich die Entwicklungen damals überschlugen. Die Geschwindigkeit, mit der sich der technische Fortschritt gerade vollzieht, ist ähnlich gewaltig. Wie vor fünfzig Jahren beschleunigt dieser Fortschritt die Auflösung von Institutionen. Wirtschaft, Politik und Bildung sind infrage gestellt. Geistesarbeit wird automatisiert, Kommunikation findet immer häufiger zwischen Mensch und Maschine statt, selbst Emotionen werden zu berechenbaren Datenpaketen.

So überraschend der KI-Boom im Herbst 2022 begann und eine Geschwindigkeit aufnahm, die einen auch dann beeindruckt, wenn man sich schon länger mit der digitalen Welt befasst, das kommt alles nicht plötzlich aus dem Nichts. KI ist eine Technologie aus den Fünfzigerjahren. Die digitale Gesellschaft hat sich über Jahrzehnte entwickelt. Und selbst die neuen KI-Modelle, die eigenständig agieren und die mithilfe von Menschen Texte, Bilder und Videos produzieren können, gibt es seit über zehn Jahren. Deswegen geht die Menschheit nicht unvorbereitet über die Schwelle zu dieser neuen Phase der Digitalisierung.

Was sich in den vergangenen dreieinhalb Jahrzehnten vollzogen hat, war die Entstehung einer digitalen Gesellschaft, in der Informationen Rohstoffe und Produkte als größten Wert abgelöst haben. Man hat als Reporter selten das Glück, einen historischen Abschnitt von Anfang bis zu seinem Übergang ins nächste Kapitel zu begleiten. Wobei sich Entwicklungen von einem Ausmaß wie dem Aufstieg der digitalen Kultur vom Biotop einer Subkultur aus Wissenschaftlern und Techies zum Betriebssystem für die moderne Gesellschaft selten in einer solchen Geschwindigkeit vollziehen.

Begonnen hat das alles mit dem Mauerfall. Zwischen dem Ende des Zweiten Weltkrieges und dem Ende des Kalten Krieges lag eine lange Phase der Forschung. Rechner waren die meiste Zeit Werkzeuge und Forschungsobjekte von Universitäten, Konzernen und Militärs. Mit dem Ende des Kalten Krieges kam aber auch das, was der Politologe Francis Fukuyama erst einmal als Ende der Geschichte deklarierte. Aus dem Wettkampf der Ideen des 20. Jahrhunderts war der Kapitalismus mit seinen Idealen von der Freiheit der Märkte und Menschen als Sieger übrig geblieben. Forschung und Technik verloren aber auch ihre Geldquellen aus diesem Wettrennen, in dem sie als intellektuelle Muskelspiele ganzer Nationen nur selten in Wertschöpfungsketten gezwungen wurden.

Ende der Achtzigerjahre änderte sich das. Als ich den Pionieren der digitalen Gesellschaft zu dieser Zeit erstmals begegnete, war diese digitale Gesellschaft noch eine Vision. Jetzt ist sie Realität. Nicht nur das. Die digitale Gesellschaft war auch der Siegeszug einer sehr kleinen Gruppe Männer, die mehr Reichtum anhäuften als jemals zuvor in der Geschichte der Menschheit.

Die Geschichte dieses digitalen Universums ist wie so vieles in dieser virtuellen Welt ein Spiegelbild der wahren Welt. Von ihrem Ursprung in den Achtzigerjahren bis heute findet man unzählige Parallelen. Selbst die Phasen der Geschichte gleichen sich, weswegen die Kapitel der ersten Jahrzehnte in diesem Buch diese historischen Abschnitte im Titel tragen. Das manifestierte sich hin und wieder in direkten Parallelen. Die Unterseekabel, welche die Kontinente mit dem Internet verbinden, verlaufen zum Beispiel entlang der Seehandelsrouten aus dem 15. und 16. Jahrhundert. Das Silicon Valley wäre in diesem Bild die East India Company der Gegenwart. Ähnlich wie die Kaufmannsgesellschaft des britischen Kolonialreiches ist das Zentrum der digitalen Industrie reicher und damit auch mächtiger als die Nation, aus der sie ihre Geschäfte betreibt. Die East India Company verfügte auf ihrem Höhepunkt um 1800 über mehr Reichtum und vor allem über mehr Soldaten als die Krone. 200 000 Mann standen unter ihrem Befehl. Damit zementierten die Händler ihre Macht nicht nur in Indien, sondern auch in China und den südostasiatischen Inselreichen. Das war der Punkt, an dem die Krone einschritt, vor allem mit Gesetzen.

Die digitale Industrie ist an einem ähnlichen Punkt. Im Jahr 2021 summierten sich die Einkünfte der Big 5 aus dem Silicon Valley – also Amazon, Apple, Facebooks Mutterkonzern Meta, Googles Mutterkonzern Alphabet und Microsoft – auf 1,4 Billionen US-Dollar. Das Budget der amerikanischen Streitkräfte, also der mächtigsten und größten Armee der Welt, wurde in dem Jahr für 2022 auf etwas mehr als die Hälfte, auf 766 Milliarden Dollar festgelegt. Kein Wunder also, dass sich nicht nur die Menschen, sondern auch die Nationen vor dieser Macht fürchten, die aus dem Nichts und mit ein wenig Strom, Licht und Silizium ein Weltreich errichtet hat. Erste Vorstöße der Exekutive in den USA und der Gesetzgeber in Europa gibt es. Und auch im Volk der Nutzer rührt sich Widerstand.

Wenn ich nun die Geschichte der digitalen Gesellschaft aufschreibe, dann nicht mit der Analyse des Historikers, sondern mit meinen Erfahrungen als Reporter und den Erlebnissen als Zeitzeuge. Wenn ich dabei meist das generische Maskulinum verwende, ist das keine grammatikalische Bequemlichkeit, sondern die Realität der Welt der Technologie und Wissenschaften. Erst langsam bekommen Frauen in dieser Geschichte tragende Rollen. Meist noch als Whistleblowerinnen, so wie Frances Haugen, Brittany Kaiser und Sophie Zhang, oder als Kritikerinnen, so wie Shoshana Zuboff, Timnit Gebru und Emily Bender. Genialische Pionierinnen wie die Informatikerinnen Fei-Fei Li, Rosalind Picard oder Elisabeth André sind noch die Ausnahme.

Man kann aus dieser Geschichte sicherlich lernen. Was für Schlüsse man daraus ziehen mag, überlasse ich den Leserinnen und Lesern. Nur eines steht fest: Angst muss man keine haben, weder vor der Digitalisierung noch vor der künstlichen Intelligenz. Dreißig Jahre sind nur ein Augenblick in der Geschichte der Menschheit, selbst in einer Familiengeschichte nur eine Generation. Und doch ist es genug Zeit, um Erfahrungen zu sammeln, mit diesen neuen Technologien umzugehen.

Es sind vor allem Missverständnisse, die zu Problemen führen. Jeder kennt den Leitspruch der digitalen Kultur »Information wants to be free«. Das war nie als Freiheitsbegriff gemeint, sondern bedeutete, dass Informationen umsonst sein sollten. Das hat ganze Branchen und vor allem die Kultur um ihre Existenzgrundlagen gebracht. Ganz so aber war das nicht gemeint. Es handelte sich vielmehr um eine Überlegung, die der Vordenker der Hippie- und dann der digitalen Bewegung Stewart Brand 1984 anstellte. Da saß er mit seinem Freund, dem Literaturagenten John Brockman, bei der ersten Hackerkonferenz in einem alten Armeestützpunkt in Marin County an einem Tisch. Brand sagte damals: »Einerseits wollen Informationen teuer sein, weil sie so wertvoll sind. Die richtige Information an der richtigen Stelle verändert dein ganzes Leben. Auf der anderen Seite wollen Informationen kostenlos sein, weil die Kosten für ihre Verbreitung immer niedriger werden. Diese beiden Dinge stehen also im Widerspruch zueinander.« Das war kein Credo. Er beschrieb nur früh schon die Dynamik, die wenige Jahre später das Internet entfesseln sollte.

Ein ähnliches Missverständnis gab es zu Beginn des Sprungs der künstlichen Intelligenz ins wirkliche Leben. Der bekannteste und beliebteste Physiker seit Albert Einstein, Stephen Hawking, sprach seit Mitte der Zehnerjahre immer wieder über KI. Meist wurde er so zitiert, als habe er die Menschheit vor ihrem nahen Ende durch KI gewarnt. In Wahrheit formulierte er eine der wichtigsten Gewissheiten der Wissenschaft, dass man nämlich nichts mit Gewissheit wissen kann, bevor es nicht bewiesen ist.

Bei der Web-Summit-Konferenz in Lissabon brachte er das 2017 nur wenige Monate vor seinem Tod wie folgt auf den Punkt: »Erfolg bei der Erschaffung effektiver künstlicher Intelligenz könnte das größte Ereignis in der Geschichte unserer Zivilisation werden. Oder das schlimmste. Wir wissen es einfach nicht. Deswegen können wir auch nicht sagen, ob uns künstliche Intelligenz letztlich helfen wird, ob sie uns ignoriert, ob sie uns kaltstellt oder zerstört. Wenn wir nicht lernen, wie wir uns darauf vorbereiten und potenzielle Risiken vermeiden, könnte künstliche Intelligenz auch das schlimmste Ereignis in der Geschichte unserer Zivilisation sein. Sie bringt Gefahren mit sich wie autonome Waffen, neue Wege für die wenigen, die vielen zu unterdrücken. Und sie könnte unser Wirtschaftssystem nachhaltig zerstören. Ich bin aber ein Optimist und glaube, dass wir künstliche Intelligenz zum Wohle der Menschheit erschaffen können.«

Genau so ist das immer noch. Niemand weiß, ob künstliche Intelligenz der Menschheit Schaden zufügen wird oder ob sie einen Fortschritt möglich macht, der die großen Probleme der Menschheit wie die Klimakatastrophe, Krankheit und Seuchen oder den Raubbau der Ressourcen löst. Weil sich aber vieles nicht nur in der Geschichte der digitalen Gesellschaft, sondern auch in ihren Erfahrungen mit neuen Technologien ähnelt oder sogar wiederholt, findet sich in den letzten dreieinhalb Jahrzehnten genug, was einem die Angst nehmen und die Vorsicht schärfen kann. Denn eins ist sicher: Die Zukunft wird digital.

1. KapitelJäger und Sammler

Wie der Mauerfall den Aufstieg der digitalen Gesellschaft auslöste und sie in einem Forschungslabor am Massachusetts Institute of Technology die Menschheit neu sortierten.

Die Zukunft erkennt man am besten, wenn sie Vergangenheit ist. In jenen Frühlingstagen des Jahres 1989 konnte ich noch nicht ahnen, dass all das, was mir die Wissenschaftlerinnen und Forscher im Media Lab des Massachusetts Institute of Technology erzählten und zeigten, der Beginn der Geschichte der digitalen Gesellschaft war. Vieles ist inzwischen schon Wirklichkeit, manches schon Alltag, einiges immer noch in der Entwicklung. Damals verstand ich nichts.

Das Media Lab ist ein futuristisches Gebäude auf dem Campus in Cambridge, nicht weit vom Charles River, auf dem an so einem sonnigen Morgen die Rudermannschaften mit ihren Choreografien der Kraft und am Ufer die Jogger ihre Runden drehten. Der Architekt I. M. Pei hatte die Außenhaut des Zukunftslabors mit weißen Kacheln verkleidet, als habe er ein Blatt Funktionspapier für Mathematiker um das Gebäude gespannt. Innen trat ich in eine Halle, über der sich die gläsernen Großraum-Laboratorien sechs Stockwerke hoch um ein Atrium herum anordneten, in dem kaum ein Mensch zu sehen war. Ein Glasdach flutete Licht in die Halle. Am Empfang wartete ein Doktorand, der mit Geduld erst einmal übers Wetter redete, weil er wusste, dass die Ideen, die sie hier wälzten, eigentlich viel zu groß waren für einen Besuch von ein paar Tagen.

Der Informatiker Nicholas Negroponte hatte das Institut 1985 gegründet. Er war 45 Jahre alt und trug auch an diesem Vormittag Maßanzug über messerscharfem Hemdkragen und formulierte seine Erkenntnisse mit der Selbstsicherheit eines Hollywoodstars. Er beherrschte den Politikerhändedruck und das Filmstarlächeln, den Verständnisblick und das Crescendo vom Smalltalk zur Vision, mit dem er damals Industriekapitäne, Wissenschaftsstars und Reporter rumkriegte. Sein Büro war gleichzeitig Besuchszentrum und Kommandozentrale. Eine Raumflucht voller Sonnenlicht, in der es keinen Schreib-, sondern nur einen Konferenztisch gab. Aus einer Ecke glomm rund um die Uhr das elektrische Schimmern von ein paar Rechnern. An einer Wand standen zwei Pachinko-Maschinen, jene bunten Spielautomaten aus Japan, in denen Kugeln an Stahlstäben entlang herunterkullern und dabei viel Lärm machen. Man hätte sie als Memento des Zeitalters der Mechanik deuten können, sie waren aber vor allem hübsch und bunt inmitten der Zweckfarben im Institut, die sonst nur die Farbstreifen der Außen- und Innenfassaden durchbrachen. »Sie sind also aus Deutschland?« Negroponte verstand es, die Leute erst einmal auf seine Seite zu ziehen. »Aus welcher Stadt? München? Ach, da ist es doch sehr schön. Gleich bei den Alpen.« Schlichter Politikertrick, funktioniert aber. Wenn man aber nicht einfach nur ein Wahlkampfprogramm, sondern gleich eine ganze Vision für einen historischen Wandel im Sinn hat, sind solche Freundlichkeiten mentale Lockerungsübungen. Es gab bei ihm dann auch Wandel mit voller Wucht.

Nicholas Negroponte war der Überzeugung, dass sämtliche Medien vom Telefon über Bücher, Zeitungen, Zeitschriften, Tonaufnahmen, Film bis hin zum Fernsehen in nicht allzu ferner Zukunft zu einer neuen Kommunikationsform verschmelzen würden, in deren Zentrum der Computer stünde. Was heute Alltag ist, klang damals noch wie Spinnerei. Er sah das aber nicht nur als technischen Fortschritt, sondern als gesellschaftlichen Wandel. Das aber könne nur gelingen, wenn die Forscherinnen und Forscher nicht mehr jede für sich an ihren Projekten arbeiteten. Informatiker und Mathematiker taten sich im Media Lab nach seiner Vision mit Medienwissenschaftlern, Designern, Soziologen und Künstlern zusammen, um gemeinsam an dieser Zukunft der vereinten Medien zu arbeiten. Das war etwas Großes, von dem damals noch niemand ahnen konnte, dass es nicht nur Wissenschaft und Technik, sondern, genau so, wie es Negroponte voraussah, auch den Alltag der Menschen, ja die Menschheit an sich von Grund auf verändern würde.

Bis heute gibt es keinen schlüssigen Begriff für diesen Wandel. Das Internet ist nur die Infrastruktur. Die Digitalisierung ist der Wandlungsprozess. Der Cyberspace ist die Ordnung der Rechenräume. Das Metaverse ist seine Visualisierung. Künstliche Intelligenz ist die Methode für ein System, das unserem Denken eine neue Struktur gibt. Zum ersten Mal in ihrer Geschichte können Menschen ihre geistigen Fähigkeiten auslagern und durch Maschinen verstärken lassen, so wie sie einst die Muskelarbeit erst auf Hebel und dann an immer komplexere Maschinen übertrugen und so weit verstärkten, bis sie buchstäblich zu den Sternen im Himmel aufbrechen konnten.

Wenn man davon ausgeht, dass der Instinkt der Menschheit von Anfang an war, nicht einfach nur zu überleben, sondern ihre Hirnleistung zu vergrößern und damit zur dominierenden Spezies auf diesem Planeten aufzusteigen, wenn man den Anfang dieser Entwicklung mit der Entdeckung des Feuers datiert, dann schlugen sie hier im Media Lab den Funken, der den Aufstieg der digitalen Menschheit in Gang brachte. Wenn man das Massachusetts Institute of Technology als so etwas wie das Rift Valley der digitalen Menschheit betrachtet, und das Media Lab als ihr Jericho, dann begann dort vor rund vierzig Jahren eine Entwicklung, mit der die Menschheit schon jetzt weit über sich hinausgewachsen ist und die noch lange nicht zu Ende ist. Diese neue Lebensform in den gläsernen Siliziumherzen der Maschinen ist den Menschen aber immer noch so fremd, auch wenn sie sich längst darauf eingelassen haben. Das ist die vieltausendfache Beschleunigung einer Entwicklung, mit der wir in der wirklichen Welt als Homo sapiens innerhalb von 40 000 Jahren von Jägern und Sammlern zu einer Kultur- und Techno-Zivilisation wurden. Nicht schlecht für eine Spezies, die dazu neigt, sich mit Raubbau, Krieg und Völlerei immer wieder in kollektive Lebensgefahr zu bringen. Das vollzog sich nicht immer zum Gemeinwohl aller, doch was die digitale Welt freisetzte, war nach der Beherrschung des Feuers, nach der Erfindung des Buchdrucks und der Elektrizität der vierte Urknall des menschlichen Geistes.

Die ersten zwei Schübe fanden noch physisch in unseren Köpfen statt. Mit der Beherrschung des Feuers erweiterte sich unser Speiseplan. Fisch und Fleisch pumpten so viele Vitamin B-12 und Proteine in unsere Körper, dass unsere Hirne ins vergleichsweise Unermessliche wuchsen. Mit dem Buchdruck explodierten die Gedanken, Ideen und das Wissen der Menschen über den gesamten Planeten. Die Elektrizität befreite uns schließlich von den Grenzen von Raum und vor allem Zeit. Was viele nutzten, um fortan mit ihrem Hirn, anstatt mit ihren Muskeln zu arbeiten. Es war der logische nächste Schritt, nun auch das Gehirn und den Geist von den niederen Arbeiten zu erlösen. Viel mehr noch, ähnlich wie die Menschheit in ihren Frühzeiten in Jagdgemeinschaften, Dörfern und Städten zusammenfand, um sich die Arbeit und dann den Überschuss zu teilen, sollte sich auch die digitale Menschheit schon bald zusammenfinden, um gemeinsam einen Weltgeist zu schaffen, der all die Gedanken, Ideen und das Wissen vereinen und für alle begreifbar machen sollte.

Das war zumindest der Plan, den sie im Media Lab des Massachusetts Institute of Technology in Cambridge geschmiedet hatten.

Ich hatte in diesem Frühjahr 1989 erst einmal gar keine Lust, diese Computermenschen zu besuchen. Ich lebte seit einem Jahr in New York, war Korrespondent eines Monatsmagazins namens Tempo, das sich zum Ziel gesetzt hatte eine »Zeitschrift für Zeitgeist« zu sein. Das war Mitte der Achtzigerjahre vor allem eine Abkehr von den Ideologien, Dogmen und Verkrustungen, die aus dem Generationenkonflikt der 68er übrig geblieben waren. Pop, Politik und Gesellschaft hatten als Berichtsgebiete gleichen Wert, genauso wie Mode, Musik und Film mit der gleichen Ernsthaftigkeit behandelt wurden wie Gerechtigkeit, Wissenschaft und der immer allgegenwärtige Umsturz der alten Gewissheiten.

Die Stadt New York war damals ein Mahlstrom mit seinen Clubs in ehemaligen Ballsälen, Banken und Fabrikhallen, in denen sich die Vergnügungssüchtigen mit Künstlern, Musikern und Intellektuellen mischten, in denen Mikrosoziotope die letzten Fronten der Bürgerrechtsbewegung bildeten und sich die Subkulturen vom Mehltau der Hippie- und Punk-Jahre befreiten. Ich trieb mich mit den Pionieren des Hip-Hops und Veteranen des Modern Jazz herum, begegnete Film-, Pop- und Kunststars. Ich hatte gerade meine ersten Krisenreportagen veröffentlicht, über Streetgangs in Los Angeles und über den Drogenkrieg in Kolumbien. Die Gegenwart war so viel spannender als die Vergangenheit und Zukunft.

Die Vergangenheit hatte daheim in Deutschland hinter jeder Ecke gelauert. Was für eine Befreiung es gewesen war, nach Amerika zu übersiedeln, wo die Gegenwart nicht mehr der Endpunkt der Geschichte war, sondern der Beginn der Zukunft. Für mich hatte da ganz persönlich eine neue Zeitrechnung begonnen.

Für die Redaktionen daheim in Deutschland waren Geschichten aus Amerika vor allem ein Gegengewicht zur Strenge des zentralen Themas dieser Zeit. Was sich da im Osten der Republik und des Kontinents anbahnte, schien zwar wie der Sieg des kapitalistischen Utopias über die Diktaturen des Sozialismus. Der Kampfgeist und die Aufbruchsstimmung hatten einerseits etwas Elektrisierendes. Auf der anderen Seite war die Wirklichkeit, die den Reporterinnen und Reportern da im Osten begegnete. Eine Welt mit tristen Stadtlandschaften und mürrischen Menschen, ein riesiger Teil des Planeten, in dem die Mehrheit der Menschen den fehlgeleiteten Plänen und Ideen einiger weniger folgen musste. In Amerika herrschte noch die Frische des Wilden Westens. Es war ein Kosmos von popkulturellen Supernovas und ikonischen Verrückten. Was immer an Härte vorhanden war, wurde in Filmen und Fernsehserien romantisiert. Selbst ein Ausflug in die brutalen Ghettos von Los Angeles schien glamourös, mit seinen Sonnenbrillen tragenden Schlägern, die Arme voller Tattoos. Amerika war aber auch das Mutterland des Zukunftsglaubens. Und um die Zukunft ging es in diesen Wendezeiten.

Für einen 26-jährigen Reporter in New York reichte die Zukunft allerdings selten weiter als der nächste Redaktionsschluss, die nächste Party, die nächste Reise. Und Computer waren Büromaschinen, für die sich Leute interessierten, die sich darüber unterhielten, wie viele Daten ein Gerät speichern und wie schnell es sie verarbeiten kann. Das erinnerte an die Sonderlinge, die sich Stereoanlagen mit vielen Knöpfen kauften und sich sehr viel mehr für Wattzahlen als für Musik interessierten, oder die in ihren Garagen an Motorrädern herumschraubten, um den Motoren noch ein paar PS mehr zu entlocken. Die Redaktion hatte mir zwar einen dieser neuen tragbaren Rechner gekauft, einen Mitsubishi MP 286L, faustdick, fast sechs Kilo schwer und nur mit Netzteil zu betreiben. »Luggable« nannte man die damals, oder auf Deutsch auch kalauerig »Schlepptop«. Beim Start machte die Festplatte laute Kratz- und Surrgeräusche. Das Internet gab es ja schon. Was 1969 mit Geldern aus dem Verteidigungsministerium unter dem Namen Arpanet als Zusammenschluss der Rechner in vier Universitäten des amerikanischen Westens begonnen hatte, war in zwanzig Jahren zu einem Netzwerk angewachsen, das nur noch schwer zu überblicken war. Erste Anbieter wie Compuserve und America Online versuchten, mit kruden Benutzeroberflächen den Massenmarkt zu erobern. Aber um das Gerät zu bedienen, musste man die Codes der Nutzersprache MS-Dos lernen, lange Reihen von Befehlsformeln, Buchstaben und Satzzeichen, die man in blau schimmernden Lichtreihen auf den schwarzen Bildschirm schrieb. Und weil wir in Deutschland mit dem Internet noch nicht so weit waren, musste ich die Texte ausdrucken und mit einer Faxmaschine nach Deutschland übertragen, die die Textseiten mit Stottergeräuschen auf ihre Walze zog. Die Anleitung, wie man das Modem anschloss, lag irgendwo im Küchenschrank. Da blieb sie auch.

In den Laborräumen des Media Labs herrschte dagegen Maschinenruhe. Die Rechnerstationen gaben höchstens ein Summen von sich. Sie waren Ausläufer eines Netzwerkes. In den Tiefen des Gebäudes verrichtete der Zentralcomputer in der Kühle eines eigenen Raumes die eigentliche Arbeit. Hin und wieder hörte man aus irgendeiner Ecke das Schnarren eines Nadeldruckers. Labor schien der falsche Begriff. Die meisten Forschungsbereiche sahen aus wie Großraumbüros. Ein wenig unaufgeräumt vielleicht mit Krimskrams, Ausdrucken und Büchern, die sich auf den Tischen stapelten. Die Wissenschaftlerinnen und Wissenschaftler sprachen im Ton der Gewissheit mit Besuch, aber auch miteinander. Da schwang eine Aufbruchsstimmung in ihren Stimmen, die ansteckend wirkte, auch wenn man ihnen nicht immer folgen konnte. Ihre eigentliche Arbeit aber war es, voller Konzentration auf ihre Bildschirme zu blicken. Ich konnte nicht wissen, dass in den Rechenmaschinen gerade eine eigene Welt heranwuchs, die große Teile der Realität, wie wir sie bis dahin kannten, verschlingen würde.

Die Laboratorien hatten nicht nur Nummern und Fachbereiche, manche trugen Namen wie aus einem Science-Fiction-Roman. Da gab es den »Terminal Garden« und das »Vivarium«, als werde hier neues Leben geschaffen. Auch das hatte einen wahren Kern, denn mit der künstlichen Intelligenz entwickelten die Maschinen Fähigkeiten, die ihre Schöpfer bald schon nur noch im Prinzip und nicht mehr in ihrer Funktion verstehen würden. Die Maschinen machten dabei einen historischen Sprung. Sie wurden unabhängig. Seit die Urmenschen einen Holzknüppel benutzt hatten, um einen Stein den Hügel hinunterzurollen, hatte sich das Prinzip Maschine nicht mehr verändert. Der Mensch bedient einen Hebel, die Maschine führt seinen Willen aus und bringt etwas in Bewegung. Die Automatisierung verschaffte den Maschinen erste Selbstständigkeit. Doch dass Maschinen selbst Entscheidungen treffen, war neu.

Die Selbstsicherheit, mit der die jungen Wissenschaftlerinnen und Wissenschaftler bei den Rundgängen durch diese Brutstätten der neuen Maschinenwelten über ihre Arbeit sprachen, entwickelte sofort einen ganz eigenen Sog. Das waren keine Zweifler, die in der Abgeschiedenheit ihrer Laborräume an Erfindungen arbeiteten. Diese Zeiten der Jäger-und-Sammler-Mentalität in den digitalen Wissenschaften fanden im Media Lab ihr Ende. Die Gemeinsamkeit, mit der sie forschten, gab ihnen das Gefühl, zu einer Bewegung zu gehören.

Die Projekte, an denen sie arbeiteten, wirkten wie aus einem Science-Fiction-Comic. Die »Jetsons« liefen damals noch im Fernsehen mit einer Familie aus knubbel- und stupsnasigen Zukunftsmenschen, die in einer Welt lebten, die genau solche Dinge benutzten, wie sie im Media Lab entwickelt wurden. Die »persönliche Zeitung« sollte Nachrichten nach den Interessen und Bedürfnissen ihrer Leserinnen und Leser sortieren. Das »Paperback Movie« sollte ganze Kinofilme auf eine einzige CD pressen. Das intelligente Fernsehen sollte aus der Einbahnstraße zwischen Sendern und Empfängern eine mehrspurige Autobahn der Signale machen. Finger sollten die Eingabegeräte ersetzen, die Fingerkuppen wie Steuergeräte auf Bildschirmen arbeiten, die auf Berührung reagierten. Nicht nur das, im »Media Room« stand nur noch ein schlicht eleganter Eames Chair in einem leeren Raum, der statt Wände Projektionsflächen hatte, die auf Gesten und Sprachen reagierten. Dort konnte man im Sesselleder lümmeln und dem Computer die Befehle einfach zuwinken und -rufen. Da wurde aus dem Rechner eine Präsenz. Der sogenannte Back Seat Driver war ähnlich, er sollte Autos ganz ohne menschliche Hilfe steuern. Andere Gruppen arbeiteten daran, dass Computer irgendwann einmal nicht mehr nur in Rechnerräumen und auf Schreibtischen stehen, sondern am Körper getragen werden könnten. Filme und Musik sollten nicht mehr auf Zelluloidrollen und Vinylplatten erschienen, sondern zerlegt als Daten in Rechnern gespeichert werden. Vor allem dieser Versuch war die perfekte Inkarnation eines neuen Leitsatzes, den Nicholas Negroponte geprägt hatte: »Atoms to bits«. Atome zu Daten. Was so abstrakt wie beiläufig klang, sollte in den kommenden Jahrzehnten ganze Industrien aushebeln. Mit diesen drei Worten hatte die Entmaterialisierung der Welt ihren Anfang genommen.

Rund vierzig Jahre später wirken die Standards der Alltagskommunikation der späten Achtzigerjahre, die Telefonzellen und Fernschreiber, die Musikspieler, die man mit Kassetten, und die Kameras, die man mit Filmkanistern befüllte, so altertümlich wie damals Dampfmaschinen, Telegrafen und kurbelbetriebene Wäscheschleudern. Jahre später sollten in den sozialen Medien diese Vorher-nachher-Witzfotos die Runde machen, die einen Schreibtisch aus dem Jahr 1984 mit einem Schreibtisch aus dem Jahr 2014 verglichen. Der erste ist noch zugestellt mit Fax, Radio, Macintosh-Rechner, Kamera, Zeitung, Zeitschrift, Telefon, Taschenrechner, Globus, Rolodex, Lexika, Tesa, Klebstoff, Schere, Stifte, Kalender, Notizblock, also allem, was man halt so brauchte für einen Tag im Büro. Auf dem zweiten Bild steht nur noch ein Laptop auf dem Schreibtisch. Alle Gegenstände haben sich in Icons auf der Benutzeroberfläche aufgelöst. Das nächste Bild wäre dann ein leerer Schreibtisch und ein Smartphone, das nicht einmal mehr eine Tastatur hat. Geht es nach den Entwicklern der künstlichen Intelligenz, verschwindet auch das.

Noch etwas hatte Nicholas Negroponte formuliert, was die Wissenschaftlerinnen und Wissenschaftler im Terminal Garden, im Vivarium und all den Laboratorien und Werkstätten wie ein Mantra wiederholten. Nicht unbedingt wörtlich, aber der Satz wirkte wie ein Dogma: »Computing is not about computers anymore, it’s about living.« Beim Computing geht es nicht mehr um Computer, sondern um das Leben. Bald schon sollte sich die digitale Elite nicht mehr darum scheren, Rechner, Chips und Geräte zu entwickeln. Es gab ja immer jemanden, der die baute, in der Regel irgendwo in Asien. Die Produkte der Gegenwart und Zukunft hatten keine Gestalt mehr. Das waren Rechenvorgänge, Prozesse und Konzepte, die Milliarden erwirtschafteten, ohne dass nur ein Atom verändert wurde. Das war Licht in den Herzen aus Glas. Die Produkte waren schon bald keine Gegenstände mehr, die die Firmen verkauften, sondern Gewohnheiten.

Ein Schritt war noch zu tun, um die Computerwissenschaften in eine digitale Industrie zu verwandeln. Ein neuer Raum musste geschaffen werden, in dem all die Bits wirken konnten, in dem es keine Atome, aber eine neue Welt geben sollte, in der sie Eigenleben entwickeln würden.

In der einen Ecke des Terminal Garden lag damals ein Büro, dem sich die anderen Wissenschaftlerinnen und Wissenschaftler nur mit Ehrfurcht näherten. Ein Herr mit Habichtgesicht, Stirnglatze und Hornbrille residierte dort. Marvin Minsky. Der Name sagte mir nichts. Erst später wurde mir klar, dass dieser Mann zu jenen Pionieren gehörte, die unsere Welt für immer verändern sollten. Marvin Minsky war zusammen mit John McCarthy einer der beiden Paten der künstlichen Intelligenz, ein Forschungsbereich »der sich damit beschäftigt, Maschinen Dinge tun zu lassen, die nach Ansicht der Menschen Intelligenz erfordern«, wie er das ausdrückte.

Marvin Minsky hatte keine Geduld für die Freundlichkeiten, die Negroponte so beherrschte. Das Sendungsbewusstsein, das später in der Digitalindustrie zur allgemeinen Umgangsform werden sollte, fehlte ihm. Ich sollte ihm über die Jahre immer wieder begegnen, und immer hatte man das Gefühl, dass es ihn viel Kraft kostete, wenn ihn die Situation wie ein Abendessen oder ein Empfang zu wenigstens einem Minimum an Floskelaustausch zwingen sollte. Erst wenn man mit ihm über seine Arbeit ins Gespräch kam und vielleicht aus der eigenen Welt eine interessante Frage mitbrachte, taute er regelmäßig auf. Er hatte es über die Jahrzehnte aber auch nicht leicht. Als der KI-Boom und seine Debatten im Herbst 2022 losbrachen, war er schon seit fast sieben Jahren nicht mehr am Leben. Während seiner Zeit war künstliche Intelligenz meist ein Forschungsfeld, das viel zu viel versprach und nichts halten konnte. Er war da nicht ganz unschuldig. Immer dachte er die philosophischen und gesellschaftlichen Dimensionen seiner Erfindungen mit. Er träumte von einer »Gesellschaft der Geister«, in dem die künstliche Intelligenz nicht nur die Rolle einer Maschine spielen sollte.

In dem Begriff steckte die erste Wolke Feenstaub, mit der die digitale Welt von Beginn an davon ablenkte, dass sich die Menschen den rigiden Sortier- und Rechenvorgängen der Mathematik und der Stochastik unterordneten. Künstliche Intelligenz, kurz KI, war ein Kunstbegriff, den sich Minskys Wegbegleiter John McCarthy ausgedacht hatte. Der schrieb 1955 einen Förderantrag für die Rockefeller-Stiftung. Er wollte eine Fachtagung an der Dartmouth University veranstalten, an der er forschte. Es sollte um die »stochastische neuronale analoge Verstärkungsberechnung« gehen, die Minsky entwickelt hatte. Das war ein Begriff, den keine Prüfungskommission geschweige denn irgendjemand in der Öffentlichkeit verstanden hätte. McCarthy fand eine viel bessere Formulierung. Künstliche Intelligenz sollte das Verfahren heißen. Das klang nach Science-Fiction, nach der Machbarkeit des Unmöglichen, nach Schöpfung.

Vier Jahre zuvor, 1951, hatte Marvin Minsky sein Konzept an der Princeton University zum ersten Mal in die Praxis umgesetzt. Sein »Labyrinthlöser« SNARC war eine rund 35 Zentimeter lange krude Maschine aus den Komponenten eines Autopiloten, wie ihn die B-24-Bomber im Zweiten Weltkrieg verwendet hatten, aus Vakuumröhren, Maschinenteilen und Elektromotoren, die auf eine Holzplatte montiert waren. Die Grundprinzipien der künstlichen Intelligenz waren schon angelegt. Mit den Röhren konstruierte Minsky vierzig künstliche neuronale Zellen, mit denen diese Maschine lernen konnte, sich in einem virtuellen Labyrinth wie eine Ratte auf Futtersuche zu bewegen. Man gab Signale ein. Jede richtige Umsetzung wurde belohnt und von den Neuronen abgespeichert. Das war der Beginn des Maschinenlernens, das siebzig Jahre später in neuronalen Netzen stattfinden würde, die aus 100 Milliarden solcher künstlicher Neuronen bestehen sollten.

Minsky hatte aber noch etwas anderes erreicht. SNARC war die erste Maschine, die nicht nur funktionierte, sondern so etwas wie Benehmen entwickelte. Das ist zumindest der Eindruck, den KI bis heute auf die Menschen macht. Der eigentliche Unterschied ist, dass dies die ersten Maschinen sind, die nicht mehr den Naturgesetzen der Physik, sondern den Regeln der Informatik folgen. Die aber erfordert ein Maß an Abstraktion und Systematik im Denken, das die meisten Menschen überfordert. So war die Erfindung des Begriffs von der künstlichen Intelligenz sehr viel mehr als nur ein Verkaufsargument für einen Drittmittelantrag. Es war der Beginn der Mystifizierung einer Technologie.

Noch war es ein weiter Weg, bis KI zu einer Alltagstechnologie werden sollte. Als ich sein Büro mit den Regalmetern doppelt gestapelter Bücher, den Memorabilia und Bildschirmen betrat, war sein Forschungsfeld mal wieder eine Nische. Es herrschte gerade einer der sogenannten KI-Winter, jenen Phasen, in denen sich Forschung und Kapital von den vermeintlichen Denkmaschinen abwendeten. Viel zu groß waren die Erwartungen an eine Technologie gewesen, die zunächst nur schlichte Vorgänge automatisieren konnte. Dabei war KI nicht nur eine Maschine. Minsky hatte kurz zuvor sein Buch mit dem Titel »The Society of Mind« veröffentlicht. Da beschrieb er das Konzept, das er mit künstlicher Intelligenz entdeckt hatte. Es war ein Entwicklungsschritt, der weit über Technologie hinausgehen sollte. »Dieses Buch versucht zu erklären, wie der Verstand funktioniert«, schrieb er zu Beginn. »Wie kann Intelligenz mit Nicht-Intelligenz verschmelzen? Um diese Frage zu beantworten, zeigen wir, dass man einen Geist aus vielen kleinen Teilen zusammensetzen kann, die jeder für sich geistlos sind. Ich nenne dieses Schema, in dem jedes Teil aus vielen kleinen Prozessen besteht, ›Society of Mind‹. Diese werden wir Agenten nennen. Jeder mentale Agent kann für sich genommen nur eine einfache Sache tun, die überhaupt keinen Verstand oder Gedanken erfordert. Doch wenn wir diese Agenten in Gesellschaften zusammenführen – auf ganz bestimmte Art und Weise –, führt dies zu wahrer Intelligenz.«

Minskys Buch folgte keiner traditionellen Form der Argumentation. Er warnte seine Leserschaft gleich zu Beginn: »In diesem Buch gibt es kaum Technisches. Es ist eine Sammlung aus vielen kleinen Ideen. Jede ist an sich vernünftig, doch wenn wir sie alle zusammen verstehen, können wir die geheimsten Geheimnisse des Geistes erklären. Ein Problem besteht darin, dass diese Querverbindungen, auf die sich ihre Erklärungen verlassen, nicht in sauberen, geraden Linien von Anfang bis Ende verlaufen. Ich wünschte, ich hätte sie so angeordnet, dass man sie geradewegs von unten nach oben nachvollziehen könnte, indem man Schritt für Schritt vorankommt.« So war jedes Kapitel eine eigenständige Gedankenwelt, die mit den anderen Kapiteln in einem Kontext, aber nicht in Zusammenhang stand.

Was er da vorwegnahm, war eine neue Form des Denkens, die sich schon bald mit dem Internet verbreiten und etablieren sollte. Die Vernetzung der Ideen, der Menschen, Prozesse, des Wissens und der Information war die Grundlage der digitalen Gesellschaft. Hypertext machte das möglich, Textbausteine, die wie Türen zu neuen Texten funktionierten. Das Anklicken eines Links ist heute längst eine Alltagsgeste. Damals stellten solche Knoten und Verbindungen die Frühform jener Netze dar, die bald schon Vorgänge erlaubten, die keinen der bisherigen Erklärungsmodellen folgten. Das waren Prozesse, durch die die Digitalisierung den Aufbruch in eine Maschinenwelt möglich machte, in der die Menschen zwar alles nutzen und bedienen, aber kaum noch verstehen konnten. Und weil sich die Menschen immer schon schwertaten mit dem Umdenken und dem Wandel, war jeder neue Entwicklungsschritt der Digitalisierung immer wieder eine Herausforderung.

Marvin Minskys »Society of Mind« war aber weniger das Ende des linearen Denkens als seine Erweiterung durch das Paralleldenken. Das sollte die digitale Welt für immer verändern. Und auch die Gesellschaft. Einer seiner Schüler hatte gerade einen Superrechner gebaut, der zumindest technisch zeigte, wie das funktionieren könnte. Danny Hillis hieß er, ein bulliger Wissenschaftler, der sein Haar in einem kleinen Pferdeschwanz trug und mit seinem schelmischen Lächeln jedes Debattenpodium auf seine Seite bringen konnte. Der Firmenname war Programm: »Thinking Machines Corporation«. Am Artificial Intelligence Laboratory des MIT hatte Hillis eine neue Rechnerarchitektur entwickelt, die auf dem Prinzip miteinander vernetzter Prozessoren beruhte. Bis dahin hatten Computer noch so funktioniert, dass ein Rechnerherz einen Vorgang nach dem anderen abwickelte. Schloss man aber mehrere solcher Herzen zusammen, konnten sie solche Vorgänge verteilen. 64 000 Prozessoren hatte er zusammengeschlossen. Die Gemeinsamkeit und Gleichzeitigkeit beschleunigte die Rechenvorgänge so weit, dass zunächst gar keine Software existierte, die diese Leistung ausreizen konnte.

Geld gab es damals noch keines in den rauen Mengen, in denen die Investoren ihr Risikokapital schon bald über die digitalen Technologien verteilten sollten wie Dünger. Die Einzigen, die sich bei Hillis meldeten, waren von der Defense Advanced Research Projects Agency (DARPA), dem Forschungsinstitut des Verteidigungsministeriums. Präsident Dwight Eisenhower hatte das Institut 1958 gegründet, weil die Sowjetunion im Jahr zuvor mit Sputnik 1 den ersten Satelliten im All installiert und somit symbolisch eine Flagge im Neuland gehisst hatte.

Die Gesandten von DARPA waren keine Unbekannten in Cambridge. Das amerikanische Militär war im 20. Jahrhundert der weltgrößte Nutzer von Computern und hatte schon lange die Projekte des MIT finanziert. In Washington sahen sie in den Thinking Machines die nächste Generation der Leitsysteme für Panzer, Flugzeuge und Raketen. Der Auftrag war es, KIs zu entwickeln, die Ziele erkennen und Sprachbefehle umsetzen könnten. Was heute jedes Smartphone kann, wäre damals ein Vorsprung auf dem kalten Schlachtfeld des Wettrüstens gewesen. Doch es kam bald anders.

Mit dem Ende des Kalten Krieges ermattete das Interesse der Kalten Krieger an Forschungsprojekten und Technologien, die erst einmal keinen Nutzwert hatten, außer der Welt zuzurufen, hey, jetzt haben wir es den Sowjets aber gezeigt. Die wiederum alles daransetzten zu beweisen, dass der Sozialismus sehr viel bessere Wissenschaft betreiben kann als der Kapitalismus. Egal ob Raumfahrt, Supercomputer oder KI, all die Milliarden, die während des Wettstreits mit der Sowjetunion in Wissenschaft und Technik gepumpt wurden, fanden bald neue Bestimmungen. Ein Epochenwechsel bahnte sich an. Das war nicht nur Haushaltspolitik. Die Gelder des Kalten Krieges hatten viel Grundlagenforschung finanziert. Da gab es einen langen Atem. Das neue Geld der Wissenschaft aber kam aus den Konzernen oder aus den Start-ups, die Wissenschaftlerinnen und Wissenschaftler selbst ausgründeten. Da wurden Ergebnisse fällig, denn Aktionäre, Investoren und Kreditgeber hatten weder die Geduld noch die Ausdauer, auf eine Zukunft zu warten, von der man oft nicht wusste, ob sie denn überhaupt anfangen würde. Danny Hillis wurde so zum Vorbild für eine neue Generation Wissenschaftler. Das Ziel vieler Wissenschaftler war nun nicht mehr der Heureka-Moment, sondern die Idee, die einen an die Börse brachte.

Es gab Ausnahmen. Marvin Minsky wollte kein Unternehmen gründen. Er wollte seine Gesellschaft des Geistes verwirklichen. Das Media Lab war der perfekte Ort dafür. Die Investoren aus der Privatwirtschaft interessierten sich allerdings für ein so abstraktes Prinzip wie die künstliche Intelligenz genauso wenig wie für Waffensysteme. Nicholas Negroponte wollte dagegen die Medienwelt revolutionieren. Das verstanden sie. Fernsehsender, Verlage und Hersteller von Elektrogeräten waren Durchlauferhitzer für Milliardensummen. Computer hatten zwar schon ihren Einzug in den Alltag begonnen, aber letztlich waren es immer noch Büromaschinen. Negropontes Vision von einem vereinigten Medienreich, in dem der Privatcomputer als Herzstück sämtliche Medienformen zusammenführt, schien wie ein Heilsversprechen. »Bei der Datenverarbeitung geht es nicht mehr um Computer«, sagte er. »Es geht um das Leben an sich.«

Was er der digitalen Welt voraussagte, klang oft größenwahnsinnig. Im Rückblick lag er verdammt richtig. »Jedes Haushaltsgerät wird mehr Rechenleistung haben als jeder PC derzeit«, sagte er. Oder: »Derzeit sind Multimedia noch ein stationäres Gerät, das meist auf einem Schreibtisch oder in einem Wohnzimmer steht, weil Monitore so schwer sind. Aber sobald es kleine, dünne, helle Bildschirme mit hoher Auflösung gibt, wird sich das ändern.« Seine Teams arbeiteten an jenen Bildschirmen, die Bücher ersetzen sollten, an den Oberflächen, auf denen Finger als Eingabemodule funktionierten, an der Digitalisierung von Musik und Film, an sogenannten Wearables, die Rechenleistung an den Körper brachten. Schon in den Siebzigerjahren hatte er einen Vorläufer von Google Maps entwickelt, und mit dem selbstfahrenden Auto hatte er ja auch schon begonnen. Negroponte fand immer wieder die Worte, um den Rest der Welt davon zu überzeugen, dass hier etwas Gewaltiges entstand, ein Umbruch der Welt, wie sie die Menschen bisher kannten.

Als Redewendung setzte sich »Atoms to bits« nie durch. Kaum einer erinnert sich heute noch daran. Als Prinzip aber veränderte dieser Slogan die Welt der Menschen wie zuletzt die Entdeckung der Elektrizität und der fossilen Energien. Das hatte nicht erst mit Negropontes Media Lab begonnen, aber hier in Cambridge, Massachusetts, lag so etwas wie die Wegscheide der Geschichte. Mit dem Ende des Zweiten Weltkrieges löste Information Energie als wichtigsten Rohstoff ab. Landwirtschaft und Industrie waren auf dem Rückzug und verlagerten sich in Schwellenländer. Informationsindustrien wie die Medien, die Finanz- und bald schon die Digitalwirtschaft bestimmten fortan die Geschichtsläufe.

Negroponte blieb eine Ausnahmeerscheinung. Wissenschaftler waren keine Popstars, keine Politiker. Marvin Minsky wirkte im Vergleich oft nicht nur arrogant, sondern geradezu abweisend. »Alles, was man über Computer oder künstliche Intelligenz hört, sollte man ignorieren«, sagte er mal. »Wir stecken in den tausend Jahren ohne so eine Technologie, die alles durchdringt. Sie können lesen, was Ihre Zeitgenossen denken, aber Sie sollten bedenken, dass sie ahnungslose Wilde sind.« Die Rockstars der digitalen Welt sollten erst viel später kommen, als Unternehmer, Zerstörer und Milliardäre. Doch als ich da in den Laborräumen des MIT eine neue Welt entdeckte, hatte diese neue Zivilisation gerade erst begonnen. 1989 war das Jahr, das den Beginn der digitalen Welt bedeutete. Was zuvor wie versprengte Fürstentümer rund um das Arpanet existierte, all jene Computerverbände mit längst vergessenen Namen wie Comsat, Clarknet oder Nullnet, schloss sich erst langsam zu jener Einheit, die schon bald als Internet gefeiert wurde. Und wenn die Enthusiasten diese Erfindung mit der Entdeckung des Feuers, der Erfindung des Buchdrucks und der Elektrifizierung der Welt verglichen, schüttelten die meisten noch ihre Köpfe. Noch 1995 schrieb der Astronom Clifford Stoll in einem Gastbeitrag für das Nachrichtenmagazin Newsweek schnippisch: »Nicholas Negroponte, Direktor des MIT Media Lab, sagt voraus, dass wir bald Bücher und Zeitungen direkt über das Internet kaufen werden. Ja klar, sicher.« Der Text hatte den Titel »The Internet? Bah!«. Da standen Sätze, die später immer wieder hämisch zitiert würden, wie: »Visionäre sehen eine Zukunft mit Telearbeitern, interaktiven Bibliotheken und multimedialen Klassenzimmern. Sie sprechen von elektronischen Stadtversammlungen und virtuellen Gemeinschaften. Handel und Wirtschaft werden sich von Büros und Einkaufszentren auf Netzwerke und Modems verlagern. Und die Freiheit der digitalen Netze wird die Regierung demokratischer machen. Blödsinn.« Da hatte die digitale Revolution längst begonnen, die schon bald die Leben aller Menschen für immer verändern sollte. Und ein paar Hundert Meilen nördlich vom Silicon Valley hatte Jeff Bezos gerade Amazon gegründet.

Aber nicht nur der maulige Wissenschaftler aus San Francisco zweifelte an der digitalen Zukunft. Als Nicholas Negroponte 1995 in der Talkshow von Charlie Rose saß, klagte er: »Die Firmen scheren sich nicht um Konsumenten.« Viele Digitalkonzerne glaubten immer noch, dass die Zukunft ihrer Industrie in Büromaschinen und Großrechnern läge.

Erst einmal sollte Marvin Minsky recht behalten. Niemand konnte voraussehen, was das Internet bewirken würde, das World Wide Web, die sozialen Netzwerke, die Smartphones und dann, zu Beginn der 2020er-Jahre, die künstliche Intelligenz erst als Superkraft für die Erkennung jeglicher Muster und Raster und schließlich sogar als Schöpferin von Texten, Bildern und Codes. Zunächst aber musste er bei mir erst einmal mit der irrigen Annahme aufräumen, dass es bei Computern um Leistung und Geschwindigkeit gehe. Jaja, die Thinking Machines seien eine Sensation, sagte er. »Aber in Zukunft wird es nicht darum gehen, wie leistungsfähig ein Computer ist, sondern mit wie vielen anderen Computern er verbunden ist.« Ich verstand ihn nicht. Marvin Minsky hatte mir gerade den Siegeszug des Internets vorausgesagt. Er wusste, dass die digitale Kultur erst einmal einen Ort brauchte, an dem sich all die Jäger und Sammler finden konnten, die bis dahin in ihren Laboratorien und Instituten und Firmen und Arbeitszimmern den Aufbruch in diese neue Welt gewagt hatten. Und auch das war erst einmal schwierig zu verstehen. Der Cyberspace war ein ortloser Ort, ein zentraler Platz ohne Zentrum. Doch genau das war die Utopie eines Raumes, in dem alle gleich waren und sich ohne Grenzen zu einem Weltgeist zusammenschließen konnten, der vor allem eine Befreiung war.

2. Kapitel Die digitale Antike

Als die Subkultur in der einstigen Hippiehochburg San Francisco ihre E-Gitarren gegen Mac-Rechner tauschte und eine Vision für das Internet entwarf, zu der auch das erste soziale Netzwerk im Netz gehörte.

Man brauchte im Sommer des Jahres 1991 nicht viel Zeit, um zu begreifen, warum San Francisco in der zweiten Hälfte des 20. Jahrhunderts immer wieder so etwas wie das Athen all der neuen Zeitalter war, die hier andauernd ausgerufen wurden. Man musste nur ein wenig Zeit verbringen zwischen den viktorianischen Reihenhäusern, den Stadtparks, den Hügeln mit Blick auf die Bucht und all den Chiffren der Subkulturen, die hier ihre Spuren hinterlassen hatten. Da war der City Lights Bookstore der Beatniks mit seinen Regalen voller Gedicht- und Essaybände aus Kleinstverlagen, das Haight-Ashbury-Viertel mit den Plattenläden und Vegetarierlokalen der Hippies. Auf der anderen Seite der Bucht hielt sich an der Berkeley University der progressive Geist der Gegenkulturen. Es gab die Clubschuppen und ehemaligen Ballsäle, in denen die Metal- und Punkbands spielten. Hier war die äußerste Grenze des Zugs nach Westen. Gleich hinter der Golden Gate Bridge begann der Pazifik. Von hier aus konnte es nur noch in all die Räume gehen, die sich auf keinem Atlas mehr fanden, ins Weltall, in die Mikrokosmen der Biologie oder in die Lichtwelten der Rechner. Der Eingangsmonolog der Fernsehserie »Star Trek« über die Erkundungsreisen des Raumkreuzers U.S.S. Enterprise war wie die Präambel einer Doktrin, diese Räume zu erobern: »Der Weltraum: die letzte Grenze. Dies sind die Reisen des Raumschiffs Enterprise. Seine Mission: die Erforschung fremder neuer Welten, die Suche nach neuem Leben und neuen Zivilisationen, die kühne Reise dorthin, wo noch kein Mensch zuvor gewesen ist!«

Aus dieser Welt hatte sich in den Lagerhäusern und Manufakturgebäuden rund um die einstige Hafenstadt eine neue Subkultur formiert, die sich als Fortsetzung all der Visionen verstand, die an der San Francisco Bay ihren Anfang genommen hatten. »New Edge« nannten sie es, eine Mischung aus New Age und Edge. Das Label sollte schon bald vergessen sein. Der Geist blieb.

Unten im Silicon Valley, bei gutem Verkehr auf dem Highway 101 eine knappe Autostunde nach Süden, entwickelten sie nur die Technik. Da waren Firmen wie IBM, Hewlett Packard und Sony, die schon viele Jahrzehnte lang Rechner bauten und programmierten, ein paar Neulinge wie Apple, Intel und Silicon Graphics. Endlose Reihen von Bürokomplexen hinter Zierbüschen bestimmten die Ortsbilder. Nur die neoklassizistischen Gebäude der Stanford University, gleich einem Anker in diesen Wucherungen der Suburbia in der Mitte des Valleys, stachen heraus. Und überall roch es nach Gardenien und Wisterien. Nicht störte, nichts lärmte, nichts sonst fiel auf. Hinter dem Glas und Stahl und Beton erstreckten sich gleich nach den Pastellfarben der Empfangsbereiche Tischfluchten mit Monitorreihen. Es war eine Welt, in der Menschen und Maschinen von Kühlaggregaten in ewigen Frühlingstemperaturen gehalten wurden. Der Umgangston war von einer Freundlichkeit und einer Jovialität geprägt, die nichts preisgab und schon gar nichts vom Geist einer Revolution ahnen ließen.

San Francisco war anders. Um zwei Uhr morgens im Dezibelsturm des Toon Town Raves in einer Halle am Rande des Mission Districts von San Francisco zwischen den Abstellgleisen des Hauptbahnhofes und einem Einkaufszentrum war die Revolution schon viel greifbarer. Vielleicht nicht in Worte zu fassen. Auf der Empore standen drei Jungs an Computern und Keyboards, die sich Tasti Box nannten und mehr Hackerkollektiv als Band waren. Whoooompwhoompwhoomp-fffffFFFFFT. Wie eine Flipperkugel hatte sich die Ravekultur mit ihren Elektrobeats von Detroit und Chicago nach London und wieder zurück nach San Francisco katapultiert. In England hatten sie die Welle »Second Summer of Love« genannt, als Wiedergänger des Hippiesommers von 1967, der in San Francisco die Utopien einer Generation in den Raum stellte, die sich nicht mehr mit den Konventionen und Konsumträumen ihrer Eltern abgeben wollte, sondern an das Gute in den Menschen glaubte. Auch wenn der Rausch schon bald wieder vorbei war. Dieser zweite Sommer der Liebe, der da Ende der Achtzigerjahre begann, sollte ein wenig länger halten.

Siebentausend Menschen passten laute Hinweisschild der Feuerpolizei in die Halle, wahrscheinlich waren es mehr. Sie trugen Neonfarben, alberne Hüte, bemalte Mützen, Leuchtgirlanden und Plastikbrillen. Das war alles sehr weit weg vom Cool der Clubs meiner damaligen Wahlheimat New York, von den Türstehern, Cocktails und der Farbe Schwarz, vom Leder und den Modelabels, den DJs, die mit Raffinesse Musikkulturen zusammenmischten, immer auf der Suche nach der nächsten Nische, die den endlosen Strom der Neuigkeiten mit neuer Energie aufladen könnte. Downtown war eine Geisteshaltung, die den Wissensvorsprung als Graben zwischen Hipster- und Popkultur verstand. Das war der Gipfel des 20. Jahrhunderts mit seinen Distinktionsmechanismen, die das Prinzip des Adels über den Umweg der schwer durschaubaren Hipster-Codes in die Subkulturwelt gebracht hatte, und gleichzeitig die Rebellion gegen die Massenkulturen, die nichts anderes waren als die kapitalistische Form des Konformismus.

Das neue Zeitalter, das da in San Francisco ausgerufen wurde, war das glatte Gegenteil. Alle sollten mitmachen. Alle! Laserstrahlen schossen quer durch den Saal. Auf Leinwänden flackerten zu Tasti Box’ Beatströmen Sequenzen aus einem Gerät namens Videotoaster, mit dem auch Laien Effekte produzieren konnten, die damals mit ihren synthetischen Formen, Farben und Bewegungen wie visuelles Brausepulver wirkten. In einem Nebenraum gab es Virtual-Reality-Helme, die man über den Kopf stülpte, um in eine jener Frühformen des Metaverse einzutauchen, die noch aus grünen Vektorlinien auf schwarzem Grund bestanden. In einem anderen konnte man sich »Synchro-Energizer«-Brillen mit Kopfhörern aufsetzen, hinter denen bunte Lichter pulsierten, die angeblich eine harmonisierende Wirkung auf die Hirnströme hatten. Kaum jemand trank Alkohol, dafür gab es eine Smart Bar mit Smart Drinks und Smart Drugs. Mit Rausch hatte das wenig zu tun. Die Smart Drinks waren Nahrungsergänzungsmittel, die einem beim Denken helfen sollten. Wach wollten sie hier sein. Die Smart Drugs funktionierten ähnlich, nur wirksamer, das waren mal Psychopharmaka, mal Medikamente für Demenzpatienten oder Konzentrationsgestörte, die Hirnleistung optimierten. Ich war neugierig genug, um das zu probieren, aber das Kribbeln im Kopf kam wahrscheinlich von der Lautstärke und die gut gelaunte Wachheit von der Begeisterung, eine neue Popkultur zu entdecken. Ein paar wollten diese Wachzustände dann doch im echten Rausch erleben und bis zum nächsten Vormittag durchhalten, die schluckten X oder E oder Adam oder Eve, oder wie auch immer sie den sehr viel wirksameren synthetischen Euphoriebooster hier nannten, der in Europa als Ecstasy die Raves beschleunigte.

Die Toon-Town-Jungs und -Mädchen erzählten mir als Außenseiter dazu alles, was ich wissen wollte, und noch mehr. Von Techno-Schamanen war die Rede, von der Psychedelik der Computer und von einer Weltgemeinschaft, die sich über das Internet zusammenschließen würde, um beflügelt vom Weltwissen, das nun allen offenstand, einen Weltgeist zu schaffen. Digitale Kultur, so viel stand auch hier fest, war keine technische, sondern eine gesellschaftliche Fortschrittsbewegung mit einem Befreiungsmoment. Das war kein Bruch mit der Hippiebewegung, wie all die Formen des Cool in Europa und New York, egal ob Punk, Wave oder Downtown, sondern ganz im Gegenteil ihre Fortsetzung. Mit dem Siegeszug der Computer und des Internets, da waren sie sich in San Francisco ganz sicher, würde endlich das Wassermannzeitalter anbrechen.

Einer der Toon-Town-Jungs zeigte mir am nächsten Tag eine der ersten Pforten zur neuen Wahrnehmung des Cyberspace. Man sah ihm an, dass er seine Schlafenszeiten nach den Gezeiten des Nachtlebens und des Cyberspace ausrichtete. Seine dünnen Arme schlenkerten aus einem T-Shirt mit dem ironischen Aufdruck einer Micky Maus, seine Gesichtsfarbe hätte ein wenig Durchblutung vertragen. Er lebte im Haight Ashbury, dem ehemaligen Epizentrum der Hippiebewegung, in einem dieser viktorianischen Reihenhäuser, in denen früher auch die Rockstars der Psychdelic-Bewegung gewohnt hatten, die Grateful Dead, Jefferson Airplane, Big Brother and the Holding Company mit ihrer Sängerin Janis Joplin, die Theatergruppe Diggers mit ihren anarchischen Aktionen. Hier zwischen Platten- und Papierstapeln, Bücherbergen und Schachteln voller Kabel und Elektrokram stand unter einer Schutzhülle ein Macintosh, einer jener eleganten Computer, die eher wie ein Fernseher als wie ein Rechner aussahen, mit einer Benutzeroberfläche aus Grafiksymbolen, auf die man mit einer Maus einen kleinen Pfeil lenken konnte, der per Tastendruck dann die Funktionen auslöste, die man auslösen wollte.