9,99 €

Niedrigster Preis in 30 Tagen: 9,99 €

Niedrigster Preis in 30 Tagen: 9,99 €

Mehr erfahren.

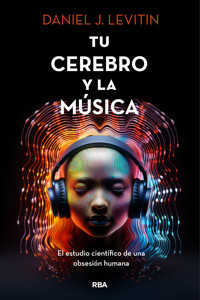

- Herausgeber: RBA Libros

- Kategorie: Geisteswissenschaft

- Sprache: Spanisch

UNA NUEVA FORMA DE ENTENDER LA MÚSICA Y LA VIDA. Si todos sabemos (o intuimos) que la música nos despierta los sentidos, este libro nos ayudará a entender cómo lo hace. El músico y neurocientífico Daniel J. Levitin compone en estas páginas una amena sinfonía de la mano de Mozart, Ella Fitzgerald o los Beatles para mostrarnos por qué escuchar música es un gran placer. «Una visión de conjunto maravillosa, a manos del único neurocientífico que podía hacerlo. Un libro importante». OLIVER SACKS

Sie lesen das E-Book in den Legimi-Apps auf:

Seitenzahl: 578

Veröffentlichungsjahr: 2018

Ähnliche

Título original: This is your Brain on Music

© Daniel J. Levitin, 2006.

© de la traducción: José Manuel Álvarez Flórez, 2008.

© de esta edición digital: RBA Libros y Publicaciones, S.L.U., 2018. Diagonal, 189 - 08018 Barcelona.

www.rbalibros.com

REF.: ODBO163

ISBN: 9788491870029

Composición digital: Newcomlab, S.L.L.

Queda rigurosamente prohibida sin autorización por escrito del editor cualquier forma de reproducción, distribución, comunicación pública o transformación de esta obra, que será sometida a las sanciones establecidas por la ley. Todos los derechos reservados.

Índice

Introducción

1. ¿Qué es música?

2. Zapateado

3. Tras el telón

4. Anticipación

5. Sabes mi nombre

6. Después del postre, Crick estaba aún a cuatro asientos de mí

7. ¿Qué se necesita para ser músico?

8. Mis cosas favoritas

9. El instinto de la música

Apéndice A

Apéndice B

Notas bibliográficas

Agradecimientos

INTRODUCCIÓN

AMO LA MÚSICA Y AMO LA CIENCIA:

¿POR QUÉ QUERRÍA MEZCLAR LAS DOS?

«Amo la ciencia, y me duele que asuste a tantos o que crean que elegir la ciencia significa que no puedes elegir también la compasión o las artes o sobrecogerte ante la naturaleza. La ciencia no tiene como objetivo curarnos del misterio, sino reinventarlo y revigorizarlo.»

ROBERT SAPOLSKY

Por qué las cebras no tienen úlcera

En el verano de 1969, cuando tenía once años, compré en una tienda de aparatos de alta fidelidad un equipo estéreo. Me costó los cien dólares que había ganado limpiando de malas hierbas los jardines de los vecinos aquella primavera a setenta y cinco centavos la hora. Pasé largas tardes en mi habitación, escuchando discos: Cream, los Rolling Stones, Chicago, Simon and Garfunkel, Bizet, Tchaikovski, George Shearing y el saxofonista Boots Randolph. No los ponía demasiado alto, al menos en comparación con mis tiempos de la universidad, cuando llegué realmente a quemar los auriculares por poner el volumen demasiado fuerte, pero el ruido era excesivo para mis padres. Mi madre es novelista; escribía a diario en la madriguera que tenía justo debajo del vestíbulo y tocaba el piano todas las noches durante una hora antes de cenar. Mi padre era un hombre de negocios; trabajaba ochenta horas a la semana, cuarenta de ellas en su despacho de casa a última hora del día y los fines de semana. Siendo como era un hombre de negocios, me hizo una propuesta: me compraría unos auriculares si le prometía utilizarlos cuando estuviera en casa. Aquellos auriculares cambiaron para siempre mi forma de escuchar música.

Los nuevos artistas a los que yo estaba escuchando exploraban por primera vez la mezcla estéreo. Como los altavoces que venían con mi equipo estéreo todo en uno de cien dólares no eran muy buenos, yo no había oído nunca con tanta profundidad como con los auriculares: el emplazamiento de los instrumentos tanto en el campo izquierda-derecha como en el espacio (reverberante) delante-atrás. Para mí, los discos dejaron de ser sólo las canciones, y pasaron a ser el sonido. Los auriculares me abrieron un mundo de colores sónicos, una paleta de matices y detalles que iban mucho más allá de los acordes y la melodía, la letra o la voz de un cantante concreto. El ambiente Sur profundo pantanoso de «Green River» de Creedence, o la belleza bucólica de espacios abiertos de «Mothers Nature’s Son» de los Beatles; los oboes de la Sexta de Beethoven (dirigida por Karajan), leves y empapados de la atmósfera de una gran iglesia de madera y de piedra; el sonido era una experiencia envolvente. Los auriculares convirtieron también la música en algo más personal; llegaba de pronto del interior de mi cabeza, no del mundo exterior. Esa conexión personal fue en el fondo la que me llevó a convertirme en ingeniero de grabación y en productor.

Muchos años después, Paul Simon me explicó que el sonido era lo que él buscaba también siempre. «Yo escucho mis grabaciones por el sonido que tienen, no por los acordes ni por la letra: mi primera impresión es el sonido global.»

Después del incidente de los auriculares en mi dormitorio dejé la universidad y me metí en una banda de rock. Conseguimos llegar a ser lo bastante buenos para grabar en un estudio de veinticuatro pistas de California con un ingeniero de talento, Mark Needham, que grabaría luego discos de gran éxito de Chris Isaac, Cake y Fleetwood Mac. Yo le caí bien, probablemente porque era el único que se interesaba por entrar en la sala de control para volver a oír cómo sonábamos, mientras los demás estaban más interesados en colocarse entre sesiones. Me trataba como a un productor, aunque yo no sabía por entonces lo que era eso, y me preguntaba cómo quería que sonara la banda. Me enseñó lo diferente que podía ser el sonido dependiendo del micrófono, e incluso la influencia que tenía la colocación del micrófono. Al principio, no percibía algunas de las diferencias que me indicaba, pero me enseñó qué era lo que tenía que escuchar. «Fíjate que cuando pongo este micrófono más cerca del amplificador de la guitarra, el sonido se hace más lleno, más redondo y más uniforme, pero cuando lo coloco más atrás, capta parte del sonido de la habitación, se vuelve más espacioso, aunque si lo hago se pierde parte del rango medio.»

Nuestra banda llegó a ser moderadamente conocida en San Francisco, y nuestras grabaciones se emitieron en estaciones de radio de rock locales. Cuando se deshizo la banda (debido a las frecuentes tentativas de suicidio del guitarrista y al desagradable hábito del vocalista de tomar óxido nitroso y cortarse con cuchillas de afeitar) encontré trabajo como productor de otras bandas. Aprendí a captar cosas que no había captado nunca: la diferencia entre un micrófono y otro, incluso entre una marca de cinta de grabación y otra (la cinta Ampex 456 tenía un «golpe» característico en el registro de baja frecuencia, Scotch 250 tenía una nitidez característica en las frecuencias altas y Agfa 467, una tersura en el registro medio). En cuanto supe qué era lo que tenía que escuchar, pude diferenciar la cinta de Ampex de la de Scotch o la de Agfa con la misma facilidad con que podía diferenciar una manzana de una pera o de una naranja. Ascendí luego de nivel y pasé a trabajar con otros grandes ingenieros, como Leslie Ann Jones (que había trabajado con Frank Sinatra y Bobby McFerrin), Fred Catero (Chicago, Janis Joplin) y Jeffrey Norman (John Fogerty, los Grateful Dead). Aunque yo era el productor (la persona a cargo de las sesiones) me sentía intimidado por todos ellos. Algunos de esos ingenieros me dejaron presenciar sus sesiones con otros artistas, como Heart, Journey, Santana, Whitney Houston y Aretha Franklin. Disfruté así de un valiosísimo curso de formación al observar cómo interactuaban con los artistas y al hablar de matices sutiles sobre cómo una parte de guitarra estaba articulada y cómo se había realizado una interpretación vocal. Hablaban de sílabas en una letra, y elegían entre diez interpretaciones distintas. Eran capaces de oír tan bien; ¿cómo ejercitaban el oído para escuchar cosas que los simples mortales no podían discernir?

Llegué a conocer, mientras trabajaba con pequeñas bandas desconocidas, a los ingenieros y directores de estudios, y ellos me orientaron para que aprendiera a trabajar cada vez mejor. Un día no apareció un ingeniero y fui yo quien empalmó varias cintas de grabación para Carlos Santana. En otra ocasión, el gran productor Sandy Pearlman salió a comer durante una sesión de Blue Öyster Cult y me dejó encargarme de terminar la parte vocal. Una cosa llevó a otra, y pasé casi una década produciendo grabaciones en California; acabé teniendo la suerte de poder trabajar con muchos músicos conocidos. Pero trabajé también con docenas de don nadies musicales, gente con mucho talento pero que nunca consiguió salir adelante. Empecé a preguntarme por qué algunos músicos llegaban a ser muy conocidos mientras otros languidecían en la oscuridad. Me pregunté también por qué la música parecía resultar tan fácil para unos y para otros no. ¿De dónde procedía la creatividad? ¿Por qué algunas canciones nos conmueven tanto y otras nos dejan fríos? Y ¿qué decir del papel de la percepción en todo esto, la asombrosa capacidad de los grandes músicos e ingenieros para apreciar matices que la mayoría de nosotros no percibimos?

Estos interrogantes me condujeron de nuevo a la universidad en busca de respuestas. Cuando aún trabajaba como productor de discos, bajaba en coche hasta la Universidad de Stanford dos veces por semana con Sandy Pearlman para asistir a las clases de neuropsicología de Karl Pribram. Descubrí que la psicología era el campo en el que estaban las respuestas a algunas de mis preguntas: preguntas sobre la memoria, la percepción, la creatividad y el instrumento común en que se basaban todas ellas: el cerebro humano. Pero en vez de encontrar respuestas, salía con más preguntas... como suele pasar con la ciencia. Y cada nueva pregunta abría mi mente a la percepción de la complejidad de la música, del mundo y de la experiencia humana. Como dice el filósofo Paul Churchland, los humanos llevan intentando comprender el mundo a lo largo de la mayor parte de la historia registrada, y justamente en los últimos doscientos años, nuestra curiosidad ha descubierto mucho de lo que la naturaleza nos había mantenido oculto: la estructura espaciotemporal, la constitución de la materia, las muchas formas de energía, los orígenes del universo, la naturaleza de la propia vida con el descubrimiento del ADN, y hace sólo cinco años, la cartografía completa del genoma humano. Pero hay un misterio que no se ha resuelto: el misterio del cerebro humano y de cómo surgen de él las ideas y los sentimientos, las esperanzas y los deseos, el amor y la experiencia de la belleza, por no mencionar la danza, el arte visual, la literatura y la música.

¿Qué es la música? ¿De dónde viene? ¿Por qué unas secuencias de sonidos nos conmueven tanto, mientras otras (como los ladridos de los perros o los patinazos de los coches) molestan a mucha gente? Para algunos, estas cuestiones suponen gran parte del trabajo de nuestra vida. Para otros, la idea de abordar de ese modo la música parece algo equivalente a estudiar la estructura química de un cuadro de Goya, dejando de ver con ello el arte que el pintor estaba intentando crear. Un historiador de Oxford, Martin Kemp, señala una similitud entre los artistas y los científicos. La mayoría de los artistas describen su trabajo como experimentos, como parte de una serie de esfuerzos destinados a explorar una preocupación común o a establecer un punto de vista. Mi buen amigo y colega William Forde Thompson (compositor y especialista en cognición musical de la Universidad de Toronto) añade que el trabajo tanto de los científicos como de los artistas incluye etapas similares de desarrollo: una etapa creativa y exploratoria de «devanarse los sesos», seguida de etapas de comprobación y perfeccionamiento que se caracterizan por la aplicación de procedimientos establecidos, pero que suelen estar acompañadas de una capacidad creadora adicional para la resolución de problemas. Los estudios de los artistas y los laboratorios de los científicos comparten también similitudes, con un gran número de proyectos en marcha al mismo tiempo, en diversas etapas de elaboración. Ambos exigen instrumentos especializados y los resultados están (a diferencia de los planos definitivos de un puente colgante o la operación de cuadrar el dinero en una cuenta bancaria al final del negocio del día) abiertos a interpretación. Lo que artistas y científicos comparten es la capacidad de vivir siempre dispuestos a interpretar y reinterpretar los resultados de su trabajo. El trabajo de ambos es en último término la búsqueda de la verdad, pero consideran que esa verdad es por su propia naturaleza contextual y variable, dependiendo del punto de vista, y que las verdades de hoy se convierten mañana en tesis repudiadas o en objetos artísticos olvidados. Basta pensar en Piaget, Freud o Skinner para encontrar teorías que tuvieron vigencia generalizada y que más tarde se desecharon (o al menos se revaluaron espectacularmente). En la música, se atribuyó de forma prematura a una serie de grupos una vigencia perdurable: se aclamó a Cheap Trick como los nuevos Beatles, y durante un tiempo la Rolling Stone Encyclopedia of Rock dedicó tanto espacio a Adam and the Ants como a U2. Hubo períodos en que no se podía concebir que un día la mayor parte del mundo no conociese los nombres de Paul Stookey, Christopher Cross o Mary Ford. Para el artista, el objetivo de la pintura o de la composición musical no es transmitir una verdad literal, sino un aspecto de una verdad universal que, si tiene éxito, seguirá conmoviendo e impresionando a la gente a pesar de que cambien los contextos, las sociedades y las culturas. Para el científico, el objetivo de una teoría es transmitir «verdad para ahora»: reemplazar una verdad vieja, aceptando al mismo tiempo que algún día esa categoría será sustituida también por una nueva «verdad», porque así es como avanza la ciencia.

La música es excepcional entre todas las actividades humanas tanto por su ubicuidad como por su antigüedad. No ha habido ninguna cultura humana conocida, ni ahora ni en cualquier época del pasado de que tengamos noticia, sin música. Algunos de los utensilios materiales más antiguos hallados en yacimientos de excavaciones humanas y protohumanas son instrumentos musicales: flautas de hueso y pieles de animales estiradas sobre tocones de árboles para hacer tambores. Siempre que los humanos se reúnen por alguna razón, allí está la música: bodas, funerales, la graduación en la universidad, los hombres desfilando para ir a la guerra, los acontecimientos deportivos, una noche en la ciudad, la oración, una cena romántica, madres acunando a sus hijos para que se duerman y estudiantes universitarios estudiando con música de fondo. Y esto se da aún más en las culturas no industrializadas que en las sociedades occidentales modernas; la música es y era en ellas parte de la urdimbre de la vida cotidiana. Sólo en fechas relativamente recientes de nuestra propia cultura, hace unos quinientos años, surgió una diferenciación que dividió en dos la sociedad, formando clases separadas de intérpretes y oyentes. En casi todo el mundo y durante la mayor parte de la historia humana, la música era una actividad tan natural como respirar y caminar, y todos participaban. Las salas de conciertos, dedicadas a la interpretación de la música, aparecieron hace muy pocos siglos.

Jim Ferguson, al que conozco desde el instituto, es hoy profesor de antropología. Es una de las personas más divertidas y más inteligentes que conozco, pero es muy tímido; no sé cómo se las arregla para dar sus cursos. Para su tesis doctoral en Harvard, hizo trabajo de campo en Lesotho, una pequeña nación rodeada por Suráfrica. Allí estudió e interactuó con los aldeanos locales, y se ganó pacientemente su confianza, hasta que un día le pidieron que participase en una de sus canciones. Y entonces, en un detalle muy propio de él, cuando los sotho le pidieron que cantara, Jim dijo en voz baja: «Yo no sé cantar», y era verdad: habíamos estado juntos en la banda del instituto y aunque tocaba muy bien el oboe, era incapaz de cantar. A los aldeanos esta objeción les pareció inexplicable y desconcertante. Ellos consideraban que cantar era una actividad normal y ordinaria que todo el mundo realizaba, jóvenes y viejos, hombres y mujeres, no una actividad reservada a unos pocos con dones especiales.

Nuestra cultura, y en realidad nuestro propio lenguaje, establece una distinción entre una clase de intérpretes especializados (los Arthur Rubinstein, Ella Fitzgerald, Paul McCartney) y los demás, que pagamos por oír que los especialistas nos entretengan. Jim sabía que no era gran cosa como cantor ni como bailarín, y para él cantar y bailar en público implicaba que debía considerarse un experto. La reacción de los aldeanos fue mirarlo con perplejidad y decir: «¿¡Qué quieres decir con lo de que no sabes cantar!? ¡Tú hablas!». Jim explicó más tarde: «A ellos les resultaba tan extraño como si les dijese que no sabía andar o bailar, a pesar de tener dos piernas». Cantar y bailar eran actividades naturales en la vida de todos, integradas sin fisuras y en las que todos participaban. El verbo cantar en su lengua (ho bina), como en muchas otras lenguas del mundo, significa también bailar; no hay ninguna distinción, porque se supone que cantar entraña movimiento corporal.

Hace un par de generaciones, antes de la televisión, muchas familias se reunían e interpretaban música juntas como diversión. Hoy se insiste mucho en la técnica y en la habilidad, y en si un músico es «lo bastante bueno» para tocar para otros. La música se ha convertido en una actividad reservada a unos cuantos en nuestra cultura, y los demás tenemos que escuchar. La industria musical es una de las de mayores en los Estados Unidos, y trabajan para ella cientos de miles de personas. Sólo las ventas de álbumes aportan 30.000 millones de dólares al año, y esta cifra no tiene en cuenta las ventas de entradas para los conciertos, los miles de bandas que tocan en locales las noches de los viernes por toda Norteamérica, ni los 30.000 millones de canciones que se bajaron gratuitamente por el procedimiento de compartir archivos en la red en 2005. Los estadounidenses gastan más dinero en música que en sexo o en medicinas recetadas. Teniendo en cuenta ese consumo voraz, yo diría que la mayoría pueden considerarse oyentes de música expertos. Tenemos capacidad cognitiva para detectar notas equivocadas, para encontrar música con la que disfrutar, para recordar cientos de melodías y para mover los pies al compás de una pieza..., una actividad que entraña un proceso de extracción de compás tan complicado que la mayoría de los ordenadores no pueden hacerlo. ¿Por qué escuchamos música y por qué estamos dispuestos a gastar tanto dinero para escuchar música? Dos entradas de conciertos pueden costar fácilmente tanto como lo que gasta en alimentación en una semana una familia de cuatro miembros, y un CD cuesta más o menos lo mismo que una camisa, ocho barras de pan o un servicio telefónico básico durante un mes. Entender por qué nos gusta la música y qué obtenemos de ella es una ventana que da acceso a la esencia de la naturaleza humana.

Plantearse interrogantes sobre una capacidad humana básica y omnipresente es planteárselos de manera implícita sobre la evolución. Los animales desarrollaron evolutivamente formas físicas determinadas como respuesta a su entorno, y las características que otorgaban una ventaja para el apareamiento se transmitieron a la generación siguiente a través de los genes.

Un aspecto sutil de la teoría darwiniana es que los organismos vivos (sean plantas, virus, insectos o animales) coevolucionaron con el mundo físico. Dicho de otro modo, mientras que todas las cosas vivas están cambiando como reacción al mundo, el mundo también está cambiando en respuesta a ellas. Si una especie desarrolló un mecanismo para mantener alejado a un predador concreto, sobre la especie de ese predador pesa la presión evolutiva bien de desarrollar un medio de superar esa defensa o bien de hallar otra fuente de alimentación. La selección natural es una carrera armamentista de morfologías físicas que cambian para adaptarse unas a otras.

Un campo científico relativamente nuevo, la psicología evolutiva, amplía la idea de evolución de lo físico al reino de lo mental. Cuando yo era estudiante en la Universidad de Stanford, mi mentor, el psicólogo cognitivo Roger Shepard, decía que no sólo nuestros cuerpos, sino también nuestras mentes, son el producto de millones de años de evolución. Nuestras pautas de pensamiento, nuestras predisposiciones para resolver problemas de determinados modos, nuestros sistemas sensoriales (como por ejemplo nuestra capacidad para ver en color, y los colores concretos que vemos) son todos ellos producto de la evolución. Shepard llevaba la cuestión aún más allá: nuestras mentes coevolucionaron con el mundo físico, modificándose para adaptarse a condiciones en constante cambio. Tres alumnos de Shepard, Leda Cosmides y John Tooby de la Universidad de California en Santa Bárbara, y Geoffrey Miller, de la Universidad de Nuevo México, figuran entre los que están a la vanguardia en este nuevo campo. Los investigadores que trabajan en él creen que pueden descubrir muchas cosas sobre la conducta humana considerando la evolución de la mente. ¿Qué función tuvo la música para la humanidad cuando estábamos evolucionando y desarrollándonos? Ciertamente, la música de hace cincuenta mil o cien mil años es muy diferente de Beethoven, Van Halen o Eminem. Igual que nuestros cerebros han evolucionado, también lo ha hecho la música que creamos con ellos, y la música que queremos oír. ¿Evolucionaron vías y zonas determinadas de nuestro cerebro específicamente para crear y escuchar música?

Descubrimientos recientes de mi laboratorio y de los de mis colegas están demostrando que la música se distribuye por todo el cerebro, en contra de la antigua idea simplista de que el arte y la música se procesan en el hemisferio derecho, mientras que el lenguaje y las matemáticas se procesan en el izquierdo. A través de estudios con individuos que padecen lesiones cerebrales, hemos visto pacientes que han perdido la capacidad de leer un periódico pero aún pueden leer música, o individuos que pueden tocar el piano pero carecen de la coordinación motriz precisa para abotonarse la chaqueta. Oír, interpretar y componer música es algo en lo que intervienen casi todas las áreas del cerebro que hemos identificado hasta ahora, y exige la participación de casi todo el subsistema neuronal. ¿Podría explicar este hecho la afirmación de que escuchar música ejercita otras partes de nuestra mente; que escuchar a Mozart veinte minutos al día nos hará más inteligentes?

Ejecutivos publicitarios, cineastas, comandantes militares y madres aprovechan el poder de la música para evocar emociones. Los publicistas utilizan la música para hacer que un refresco, una cerveza, un calzado para correr o un coche parezcan más atractivos que sus competidores. Los directores de cine utilizan la música para explicarnos lo que sienten en escenas que de otro modo podrían ser ambiguas, o para intensificar nuestros sentimientos en momentos especialmente dramáticos. Imaginemos una escena típica de persecución de una película de acción, o en la música que podría acompañar a una mujer solitaria que sube por una escalera en una vieja mansión sombría. La música se utiliza para manipular nuestras emociones y tendemos a aceptar, si es que no a disfrutar directamente, esa capacidad que tiene para hacernos experimentar diversos sentimientos. Madres de todo el mundo, y remontándonos hacia atrás en el tiempo todo lo que podamos imaginar, han utilizado el canto para dormir a los niños pequeños, o para distraerlos de algo que les ha hecho llorar.

Muchas personas que aman la música aseguran que no saben nada de música. He descubierto que muchos de mis colegas que estudian temas complejos y difíciles como la neuroquímica o la psicofarmacología no se sienten preparados para investigar la neurociencia de la música. ¿Y quién puede reprochárselo? Los teóricos de la música manejan una serie arcana y enrarecida de términos y reglas tan oscuros como algunos de los campos más esotéricos de las matemáticas. Para el que no es músico, esas manchas de tinta en una página que nosotros llamamos notación musical podrían ser comparables a las anotaciones de la teoría matemática de conjuntos. Hablar de tonalidades, cadencias, modulación y transposición puede resultar desconcertante.

Sin embargo, todos esos colegas que se sienten intimidados por esa jerga pueden decirme cuál es la música que les gusta. Mi amigo Norman White es una autoridad mundial en el hipocampo de las ratas, y en cómo recuerdan los diferentes lugares que han visitado. Es muy aficionado al jazz y puede hablar como un experto sobre sus artistas favoritos. Puede apreciar instantáneamente la diferencia entre Duke Ellington y Count Basi por el sonido de la música, y puede incluso distinguir al Louis Armstrong de la primera época a la del final. Norm no tiene ningún conocimiento musical en el sentido técnico: puede decirme que le gusta una canción determinada, pero no puede decirme los nombres de los acordes. Es sin embargo un experto en saber lo que le gusta. Eso no tiene nada de excepcional, por supuesto. Muchos de nosotros tenemos un conocimiento práctico de cosas que nos gustan, y podemos comunicar nuestras preferencias sin tener el conocimiento técnico del verdadero experto. Yo sé que prefiero la tarta de chocolate de un restaurante al que suelo ir a la tarta de chocolate de la cafetería de al lado de mi casa. Pero sólo un chef sería capaz de analizar la tarta (descomponer la experiencia gustativa en sus elementos) describiendo las diferencias en el tipo de harina, o en la mantequilla, o en el tipo de chocolate utilizados.

Es una lástima que muchas personas se sientan intimidadas por la jerga que manejan los músicos, los teóricos de la música y los científicos cognitivos. Hay un vocabulario especializado en todos los campos de investigación (pruebe a interpretar el informe completo de un análisis de sangre de su médico). Pero en el caso de la música, los científicos y los especialistas podrían esforzarse un poco más en la tarea de hacer accesible su trabajo. Se trata de algo que he intentado conseguir en este libro. El abismo antinatural que se ha abierto entre la interpretación musical y la audición de música se corresponde con el abismo paralelo que separa a los que aman la música (y les encanta hablar de ella) y los que están descubriendo cosas nuevas sobre cómo opera.

Una impresión que mis alumnos suelen confiarme es la de que aman la vida y sus misterios y temen que una excesiva educación les robe muchos de los placeres sencillos de la vida. Los alumnos de Robert Sapolsky probablemente le hayan hecho confidencias parecidas, y yo sentí también la misma angustia en 1979, cuando me trasladé a Boston para estudiar música en el Berklee College. ¿Y si adoptando un enfoque científico al estudiar la música y al analizarla la despojo de sus misterios? ¿Y si llego a saber tanto sobre ella que no me proporciona ya placer?

La música aún sigue ofreciéndome el mismo placer que cuando la oía en aquel equipo de alta fidelidad barato con los auriculares. Cuanto más llegué a saber sobre la música y sobre la ciencia más fascinantes me resultaron, y más capaz me sentí de apreciar a la gente que es realmente buena en ambos campos. La música, como la ciencia, ha resultado ser a lo largo de los años una aventura, nunca experimentada exactamente del mismo modo dos veces. Ha sido para mí una fuente de continuas sorpresas y de satisfacción. Resulta que ciencia y música no son tan mala mezcla.

Este libro trata de la ciencia de la música desde la perspectiva de la neurociencia cognitiva, el campo que se halla en la intersección de la psicología y la neurología. Analizaré algunos de los estudios más recientes que yo y otros investigadores de nuestro campo hemos realizado sobre la música, su contenido y el placer que proporciona. Aportan nuevas perspectivas de cuestiones profundas. Si todos oímos la música de una forma diferente, ¿cómo podemos explicar que algunas composiciones puedan conmover a tantas personas, el Mesías de Haendel o «Vincent (Starry Starry Night)» de Don McLean, por ejemplo? Por otra parte, si todos oímos la música del mismo modo, ¿cómo podemos explicar las amplias diferencias de preferencia musical? ¿Por qué el Mozart de un individuo es la Madonna de otro?

En los últimos años se ha profundizado en el conocimiento de la mente gracias a un campo en vertiginoso crecimiento, el de la neurociencia, y a nuevos enfoques en psicología debidos a las nuevas tecnologías de representación del cerebro, a drogas capaces de manipular neurotransmisores como la dopamina y la serotonina y con ayuda también a la simple y vieja actividad científica. Menos conocidos son los avances extraordinarios que hemos conseguido en la construcción de modelos de cómo se interconectan nuestras neuronas, gracias a la revolución incesante de la tecnología informática. Estamos llegando a entender como nunca antes habíamos podido sistemas informatizados que existen dentro de nuestra cabeza. El lenguaje parece ahora hallarse sustancialmente integrado en el cerebro. Hasta la propia conciencia ha dejado ya de estar envuelta de forma irremediable en una niebla mística, y ha pasado a ser más bien algo que surge de sistemas físicos observables. Pero nadie ha unido todo este nuevo trabajo y lo ha utilizado para elucidar lo que es para mí la más bella obsesión humana. Analizar la relación entre el cerebro y la música es una vía para llegar a entender los misterios más profundos de la naturaleza humana. Es por eso que escribí este libro.

Si comprendemos mejor lo que es la música y de dónde sale, quizá podamos comprender mejor nuestras motivaciones, temores, deseos, recuerdos e incluso la comunicación en el sentido más amplio. ¿Es escuchar música algo parecido a comer cuando tienes hambre, y satisfacer así una necesidad? ¿O se parece más a ver una bella puesta de sol o a disfrutar de un masaje en la espalda, que activan sistemas de placer sensorial en el cerebro? Ésta es la historia de cómo el cerebro y la música coevolucionaron: lo que la música puede enseñarnos sobre el cerebro, lo que el cerebro puede enseñarnos sobre la música y lo que ambos pueden enseñarnos sobre nosotros mismos.

1

¿QUÉ ES MÚSICA?

DEL TONO AL TIMBRE

¿Qué es música? Para muchos «música» sólo puede significar los grandes maestros: Beethoven, Debussy y Mozart. Para otros, «música» es Busta Rhymes, Dr. Dre y Moby. Para uno de mis profesores de saxo del Berklee College (y para legiones de aficionados al «jazz tradicional») cualquier cosa hecha antes de 1940 o después de 1960 no es en realidad música. Yo tenía amigos cuando era un crío en los años sesenta que venían a mi casa a oír a los Monkees porque sus padres les prohibían oír todo lo que no fuese música clásica, y otros cuyos padres sólo les dejaban oír y cantar himnos religiosos. Cuando Bob Dylan se atrevió a tocar una guitarra eléctrica en el festival folk de Newport en 1965 hubo gente que se fue y muchos de los que se quedaron le abuchearon. La Iglesia católica prohibió la música con polifonía (más de una pieza musical tocada al mismo tiempo), temiendo que eso haría dudar a la gente de la unicidad de Dios. La Iglesia prohibió también el intervalo musical de una cuarta aumentada, la distancia entre do y fa sostenido y conocido también como tritono (el intervalo de West Side Story de Leonard Bernstein en que Toni canta el nombre de «María»). Este intervalo se consideraba tan disonante que tenía que haber sido obra de Lucifer, y así la Iglesia lo llamó Diabolus in musica. Era el tono lo que provocaba la indignación de la Iglesia. Y fue el timbre lo que hizo que abucheasen a Dylan.

La música de compositores de vanguardia como Francis Dhomont, Robert Normandeau o Pierre Schaeffer fuerza los límites de lo que la mayoría de nosotros consideramos que es música. Yendo más allá del uso de melodía y armonía, y hasta más allá del uso de instrumentos, estos compositores se valen de grabaciones de diversos objetos, como martillos neumáticos, trenes y cataratas de agua. Corrigen luego las grabaciones, juegan con el tono y acaban combinándolas en un montaje organizado de sonido con el mismo tipo de trayectoria emotiva (la misma tensión y liberación) que la música tradicional. Los compositores de esta tradición son como los pintores que traspasaron los límites del arte realista y representativo: los cubistas, los dadaístas, muchos de los pintores modernos desde Picasso a Kandinsky y a Mondrian.

¿Qué tienen en común básicamente la música de Bach, Depeche Mode y John Cage? A un nivel más básico, ¿qué es lo que diferencia «What’s It Gonna Be?!» de Busta Rhymes o la Sonata Patética de Beethoven de, por ejemplo, la serie de sonidos que oyes si te sitúas en medio de Times Square, o de los que oyes en las profundidades de un bosque tropical? Según la definió en una frase célebre el compositor Edgard Varèse: «Música es sonido organizado».

Este libro se propone explicar desde una perspectiva neuropsicológica cómo afecta la música a nuestro cerebro, nuestra mente, nuestro pensamiento y nuestro espíritu. Pero conviene examinar primero de qué está hecha. ¿Cuáles son los componentes básicos fundamentales de la música? ¿Y cómo la originan cuando están organizados? Los elementos básicos de cualquier sonido son intensidad, tono, contorno, duración (o ritmo), tempo, timbre, ubicación espacial y reverberación. El cerebro organiza esos atributos perceptuales básicos en conceptos de nivel más elevado (igual que un pintor dispone las líneas en formas) y entre ellos se incluyen el compás, la armonía y la melodía. Cuando escuchamos música, estamos percibiendo en realidad atributos o «dimensiones» múltiples. He aquí un breve resumen de cuáles son:

Suele llamarse «tono» a un sonido musical diferenciado. Se utiliza también la palabra «nota», pero los científicos reservan esa palabra para referirse a algo que está anotado en una página o partitura de música. Los dos términos, «tono» y «nota», designan la misma entidad en el sentido abstracto, pero la palabra «tono» se refiere a lo que oyes y la palabra «nota» a lo que ves escrito en una partitura musical.

«Altura de tono» es una construcción puramente psicológica, relacionada tanto con la frecuencia real de un tono particular como con su posición relativa en la escala musical. Proporciona la respuesta a la pregunta «¿Qué nota es ésta?» («Un do sostenido»). Definiré más adelante la frecuencia y la escala musical.

«Ritmo» se refiere a las duraciones de una serie de notas, y a cómo se agrupan en unidades. Por ejemplo, en la «Alphabet Song» (lo mismo que «Twinkle, Twinkle Little Star») las notas de la canción son todas de igual duración para las letras A B C D E F G H I J K (con pausa de igual duración, o silencio, entre G y H), y luego las cuatro letras siguientes se cantan con la mitad de duración, o el doble de rápido por letra: L M N O (lo que provocó que generaciones de escolares se pasasen sus primeros meses creyendo que había una letra en el alfabeto llamada ellemmenno).

«Tempo» es la velocidad global o ritmo de la pieza.

«Contorno» es la forma global de una melodía, teniendo en cuenta sólo la pauta de «arriba» y «abajo» (si una nota sube o baja, no cuánto sube o baja).

«Timbre» es aquello que diferencia un instrumento de otro (por ejemplo, la trompeta del piano) cuando se toca con ambos la misma nota escrita. Es una especie de color tonal que se produce en parte por los armónicos de las vibraciones del instrumento.

«Intensidad» es un constructo puramente psicológico que se relaciona (no linealmente y de modos que no entendemos del todo) con la amplitud física de un tono.

«Ubicación espacial» es de dónde procede el sonido.

«Reverberación» se refiere a la percepción de lo lejos que está de nosotros la fuente del sonido en combinación con lo grande que es la habitación o sala de música en la que suena; se denomina a menudo entre los legos «eco», y es la cualidad que diferencia la amplitud del sonido cuando se canta en una sala de conciertos grande del sonido cuando cantas en la ducha. Se infravalora su influencia en la transmisión de emociones y en la producción de un sonido global agradable.

Estos atributos son separables. Puede modificarse cada uno de ellos sin alterar los demás, lo que permite estudiarlos científicamente de uno en uno, que es la razón de que podamos concebirlos como dimensiones. La diferencia entre «música» y una serie de sonidos al azar o desordenada está relacionada con el modo que tienen de combinarse estos atributos fundamentales y las relaciones que establecen entre sí. Cuando estos elementos básicos se combinan y relacionan de una forma significativa, originan conceptos de orden superior, como «compás», «tonalidad», «melodía» y «armonía».

El compás lo crea el cerebro extrayendo información de las claves de ritmo y volumen, y es el modo en que se agrupan los tonos entre sí a lo largo del tiempo. Un compás de vals organiza los tonos en grupos de tres, una marcha en grupos de dos o de cuatro.

«Tonalidad» es el orden de importancia entre los tonos en una pieza musical; esta jerarquía no existe en el mundo, existe sólo en nuestra mente, como consecuencia de nuestras experiencias con un estilo musical y con idiomas musicales y con los esquemas mentales que todos desarrollamos para entender la música.

«Melodía» es el tema principal de una pieza musical, la parte que cantas con ella, la sucesión de tonos que destacan más en tu mente. La noción de melodía varía con los géneros. En la música rock, lo característico es que haya una melodía para las estrofas y otra para el coro, y las estrofas se diferencian por un cambio en la letra y a veces por un cambio de instrumentación. En la música clásica, la melodía es un punto de partida para que el compositor cree variaciones sobre ese tema, que se pueden utilizar a lo largo de toda la pieza de formas diferentes.

La «armonía» se basa en las relaciones entre la altura de los diversos tonos, y los marcos tonales que esos tonos establecen y que crean expectativas de lo que llegará a continuación en una pieza musical..., expectativas que un compositor hábil puede satisfacer o quebrantar con finalidades expresivas y artísticas. Armonía puede significar simplemente una melodía paralela a la primaria (como cuando armonizan dos cantantes) o puede referirse a una progresión de acordes, las agrupaciones de notas que forman un marco y un fondo en el que se apoya la melodía.

La idea de elementos primarios que se combinan para crear arte, y la importancia de las relaciones entre esos elementos, se da también en el arte visual y en la danza. Los elementos principales de la percepción visual son el color (que se puede descomponer en las tres dimensiones de tono, saturación y claridad), brillantez, ubicación, textura y forma. Pero un cuadro es más que esas cosas: no es sólo una línea aquí y otra allá, o un punto de rojo en una parte y un sector de azul en otra. Lo que convierte un conjunto de líneas y de colores en arte es la relación entre una línea y otra; cómo un color o una forma se hacen eco de otro u otra en una parte distinta del cuadro. Esos toques de pintura y esas líneas se convierten en arte cuando la forma y la fluidez (cómo se ve arrastrada la mirada a lo largo del cuadro) se crean a partir de elementos perceptuales de orden inferior. Cuando se combinan armoniosamente acaban dando origen a la perspectiva, el primer plano y el plano de fondo, la emoción y otros atributos artísticos. Asimismo, la danza no es sólo un mar tempestuoso de movimientos corporales sin relación; lo que los integra y complementa es la relación de esos movimientos entre sí, lo que aporta una coherencia y una cohesión que procesan los niveles superiores del cerebro. Y en la música, lo mismo que en el arte visual, se juega no sólo con las notas que se emiten, sino con las que no se emiten. Miles Davis hizo una descripción famosa de su técnica de improvisación paralela a la descripción que hizo Picasso de cómo utilizaba él un lienzo: el aspecto más decisivo del trabajo, decían ambos artistas, no eran los objetos en sí, sino el espacio entre los objetos. Miles, en concreto, describió la parte más importante de sus solos como el espacio vacío entre notas, el «aire» que introducía entre una nota y la siguiente. Saber con exactitud cuándo emitir la nota que sigue y dar tiempo al oyente para anticiparlo, es un rasgo distintivo del talento de Davis. Resulta particularmente notorio en su álbum Kind of Blue.

Para los que no son músicos, términos como «diatónico», «cadencia» o incluso «tonalidad» y «tono» pueden constituir una barrera innecesaria. Músicos y críticos parecen vivir a veces tras un velo de términos técnicos que pueden parecer pretenciosos. ¿Cuántas veces has leído una crítica de un concierto en el periódico y te has encontrado con que no tienes ni idea de lo que está diciendo el crítico? «Su appoggiatura creó una incapacidad para completar la roulade.» O, «¡Me parece increíble que modulasen hasta do sostenido menor! ¡Qué ridículo!» Lo que en realidad queremos saber es si la música se interpretó de una forma que conmovió al público. Si la cantante pareció encarnar al personaje sobre el que estaba cantando. Tal vez quisieses que el crítico comparase la actuación de esa noche con la de la noche anterior o con un conjunto diferente. Lo que nos interesaba normalmente era la música, no los instrumentos técnicos utilizados. No aguantaríamos que el crítico gastronómico de un restaurante se pusiera a especular sobre la temperatura exacta a la que el chef añadió zumo de limón a una salsa holandesa, ni que un crítico de cine nos hablase de la apertura de lente utilizada por el cineasta; no deberíamos aguantarlo tampoco en el caso de la música.

Además, muchos de los que estudian música (incluso musicólogos y científicos) discrepan sobre el significado de alguno de esos términos. Utilizamos el término «timbre», por ejemplo, para designar el sonido global o el color tonal de un instrumento, esa característica indescriptible que diferencia a una trompeta de un clarinete aunque estén tocando la misma nota escrita, o lo que diferencia tu voz de la de Brad Pitt al pronunciar las mismas palabras. Pero la incapacidad para ponerse de acuerdo en una definición ha conducido a la comunidad científica a tomar la insólita medida de alzar las manos y definir timbre como lo que no es. (La Acoustical Society of America lo define como todo lo relacionado con un sonido que no es intensidad ni tono. ¡Menuda precisión científica!)

¿Qué es tono? Esta simple pregunta ha generado centenares de artículos científicos y miles de experimentos. Tono es la frecuencia o velocidad de vibración de una cuerda, una columna de aire u otra fuente física de sonido. Si una cuerda vibra de manera que se mueva hacia delante y hacia atrás sesenta veces en un segundo, decimos que tiene una frecuencia de sesenta ciclos por segundo. La unidad de medida, ciclos por segundo, suele llamarse hercio (abreviado Hz), por Heinrich Hertz, el físico teórico alemán que fue el primero que transmitió ondas de radio (teórico hasta la médula, cuando le preguntaron qué utilidad práctica podrían tener las ondas de radio, parece ser que se encogió de hombros y contestó: «Ninguna»). Si tuvieses que intentar remedar el sonido de la sirena de un vehículo de bomberos, tu voz recorrería diferentes tonos o frecuencias (al cambiar la tensión de tus pliegues vocales), algunos «bajos» y algunos «altos».

Las teclas de la izquierda del teclado del piano golpean cuerdas más gruesas y más largas que vibran a una tasa relativamente lenta. Las de la derecha, cuerdas más cortas y más finas que vibran a una tasa más alta. La vibración de esas cuerdas desplaza moléculas de aire y las hace vibrar a la misma velocidad, es decir, con la misma frecuencia que la cuerda. Estas moléculas de aire vibrante son las que llegan a nuestro tímpano, y lo hacen moverse hacia dentro y hacia fuera con la misma frecuencia. La única información que recibe el cerebro sobre el tono del sonido viene de ese movimiento hacia dentro y hacia fuera del tímpano; el oído interno y el cerebro tienen que analizar ese movimiento para calcular qué vibraciones del mundo exterior hacen moverse de ese modo el tímpano.

Cuando usamos las teclas más próximas a la izquierda del teclado, decimos, por convención, que son sonidos de tono «grave», y los de las próximas al lado derecho del teclado que son de tono «agudo». Es decir, los sonidos que llamamos «graves» son los que vibran lentamente, y están más próximos (en frecuencia de vibración) al sonido de los ladridos de un perro grande. Los que llamamos «agudos» son los que vibran rápidamente y están más próximos a los débiles ladridos que podría emitir un perro pequeño. Pero incluso estos términos, «agudo» y «grave», son culturalmente relativos: los griegos hablaban de los sonidos en sentido contrario, porque los instrumentos de cuerda que ellos construían tendían a estar orientados verticalmente. Las cuerdas más cortas o los tubos de órgano más cortos tenían sus partes superiores más próximas al suelo, y se llamaban por ello notas «bajas» (como en «baja hasta el suelo»), y las cuerdas y tubos más largos (que se elevaban hacia Zeus y Apolo) se llamaban notas «altas». «Bajo» y «alto» (lo mismo que «izquierda» y «derecha») son en realidad términos arbitrarios que tienen que memorizarse. Algunos autores han alegado que «alto» y «bajo» son etiquetas intuitivas, y que lo que llamamos sonidos de tono alto proceden de los pájaros (que están subidos a los árboles o en el cielo) y lo que llamamos sonidos de tono bajo suelen proceder de grandes mamíferos próximos al suelo como los osos o el ruido de un terremoto. Pero esto no resulta convincente, ya que hay sonidos bajos que vienen también de arriba (pensemos en el trueno) y sonidos altos que vienen de abajo (los grillos y las ardillas, las hojas que pisamos).

Como una primera definición de tono, digamos que es esa cualidad que distingue primordialmente el sonido asociado a pulsar una tecla de piano frente a otra.

Pulsar una tecla hace que un macillo golpee una o más cuerdas dentro del piano. Al golpearla la desplaza, estirándola un poco, y su elasticidad intrínseca hace que vuelva hacia su posición original. Pero excede esa posición original, yendo demasiado lejos en la dirección opuesta, y luego intenta volver una vez más a su posición original, excediéndose de nuevo, y oscila así hacia delante y hacia atrás. Cada oscilación va cubriendo menos distancia y llega un momento en que la cuerda dejará por completo de moverse. Por eso el sonido que oímos al pulsar una tecla de piano se suaviza hasta perderse en la nada. El cerebro traduce la distancia que la cuerda recorre con cada oscilación hacia delante y hacia atrás como intensidad; la tasa a la que oscila se traduce como altura de tono. Cuanto más lejos llega la cuerda, más fuerte nos parece el sonido; cuando casi no se desplaza, el sonido parece suave. Aunque pudiese parecer contradictorio, la distancia recorrida y la tasa de oscilación son independientes. Una cuerda puede vibrar muy deprisa y recorrer bien una gran distancia o una distancia pequeña. La extensión que recorre depende de lo fuerte que la pulsemos: esto se corresponde con nuestra intuición de que al pulsar algo más fuerte el sonido es fuerte. La velocidad a la que vibra la cuerda depende principalmente de su tamaño y de lo tensa que esté, no de lo fuerte que se haya pulsado.

Podría parecer que deberíamos limitarnos a decir que tono es lo mismo que frecuencia; es decir, la frecuencia de vibración de las moléculas de aire. Esto es casi cierto. Cartografiar el mundo físico sobre el mundo mental raras veces resulta tan directo. Sin embargo, en los sonidos más musicales, tono y frecuencia están estrechamente relacionados.

La palabra tono alude a la representación mental que un organismo tiene de la frecuencia básica de un sonido. Es decir, tono es un fenómeno psicológico relacionado con la frecuencia de las moléculas de aire que vibran. Con lo de «psicológico» quiero decir que se trata de algo que está exclusivamente en nuestra mente, no en el mundo exterior; es el producto final de una cadena de acontecimientos mentales que da origen a una representación o cualidad mental interna por completo subjetiva. Las ondas sonoras en sí mismas (moléculas de aire que vibran con frecuencias diversas) no tienen tono. Su movimiento y sus oscilaciones se pueden medir, pero hace falta un cerebro humano (o animal) para cartografiarlas respecto a esa cualidad interna que llamamos tono.

Percibimos el color de una forma similar, y fue Isaac Newton quien primero se dio cuenta de eso. (Newton, por supuesto, es conocido como el descubridor de la teoría de la gravedad, y el inventor, junto con Leibniz, del cálculo diferencial. Era, como Einstein, muy mal estudiante, y sus profesores se quejaban a veces de su falta de atención. Al final lo echaron de la escuela.)

Newton fue el primero que indicó que la luz es incolora, y que en consecuencia el color tiene que producirse dentro de nuestro cerebro. «Las ondas en sí —escribió— no tienen color.» Desde su época, hemos llegado a saber que las ondas luminosas se caracterizan por diferentes frecuencias de oscilación, y cuando impactan en la retina de un observador desencadenan una serie de fenómenos neuroquímicos cuyo producto final es una imagen mental interior a la que llamamos color. Aunque una manzana pueda parecer roja, sus átomos no son rojos. Y del mismo modo, como señala el filósofo Daniel Dennett, el calor no está compuesto de pequeñas cositas calientes.

Un budín sólo tiene gusto cuando yo lo meto en la boca, cuando entra en contacto con la lengua. No tiene gusto ni sabor cuando está en la nevera, sólo el potencial. Así también, las paredes de mi cocina no son «blancas» cuando yo abandono la cocina. Aún tienen sobre ellas pintura, por supuesto, pero el «color» sólo se produce cuando interactúan con mis ojos.

Las ondas sonoras impactan en los tímpanos y en el pabellón auricular (las partes carnosas de la oreja), poniendo en marcha una cadena de acontecimientos mecánicos y neuroquímicos cuyo producto final es una imagen mental interna a la que llamamos tono. Si cae un árbol en el bosque y no hay nadie allí para oírlo, ¿produce un sonido? (El primero que planteó esta cuestión fue el filósofo irlandés George Berkeley.) Sencillamente, no: sonido es una imagen mental creada por el cerebro en respuesta a moléculas que vibran. Del mismo modo, no puede haber tono sin un ser humano o un animal presente. Un instrumento de medición adecuado puede registrar la frecuencia producida por el árbol cayendo, pero en realidad no hay tono a menos que se oiga.

Ningún animal puede oír un tono por cada frecuencia que existe, del mismo modo que los colores que vemos son en realidad una pequeña porción del espectro electromagnético. El sonido puede oírse teóricamente para vibraciones que van justo de los 0 ciclos por segundo hasta los 100.000 o más, pero cada animal oye sólo un subconjunto de los sonidos posibles. Los seres humanos que no padecen ningún tipo de pérdida auditiva pueden normalmente oír sonidos que van desde los 20 hercios hasta los 20.000. Los tonos del extremo bajo suenan como un ruido sordo impreciso o un temblor: ése es el sonido que oímos cuando pasa un camión al otro lado de la ventana (el motor produce un sonido en torno a los 20 hercios) o cuando un coche trucado con un sistema de sonido de primera tiene puestos los bafles de bajos realmente fuerte. Algunas frecuencias (las que quedan por debajo de los 20 hercios) son inaudibles para los seres humanos, porque los mecanismos fisiológicos de nuestros oídos no son sensibles a ellas.

Que el rango de la audición humana suela ser de 20 hercios a 20.000 no significa que el rango de la percepción tónica humana sea el mismo; aunque podemos oír sonidos en ese rango completo, no todos son musicales; es decir, no podemos asignar sin ambigüedad un tono a un rango completo. Por analogía, los colores en los extremos infrarrojo y ultravioleta del espectro carecen de definición comparados con los colores más próximos al centro. La figura de la página 64 muestra el rango de los instrumentos musicales y la frecuencia asociada con ellos. El sonido de la voz del varón medio hablando es de unos 110 hercios, y el de la mujer media, de unos 220. El zumbido de las luces fluorescentes o de una instalación eléctrica defectuosa es de 60 hercios (en América del Norte; en Europa y en países con una medida diferente de voltaje/corriente puede ser de 50). El sonido que emite una cantante al romper un vaso con la voz podría llegar a ser de 1.000 hercios. El cristal se rompe porque, como todos los objetos físicos, tiene una frecuencia vibratoria intrínseca y natural. Puedes oírla dando al vaso un golpecito con el dedo o, si es de cristal fino, recorriendo el borde con el dedo mojado en un movimiento circular. Cuando la cantante alcanza la frecuencia adecuada (la frecuencia resonante del cristal) hace vibrar a las moléculas de éste a su velocidad natural, y el cristal estalla.

Un piano normal tiene 88 teclas. Los pianos pueden tener en casos muy raros unas cuantas teclas extra al fondo y los pianos eléctricos, los órganos y los sintetizadores tienen sólo 12 o 24 teclas, pero se trata de casos especiales. La nota más baja en un piano normal vibra con una frecuencia de 27,5 hercios. Curiosamente, ésta es de forma aproximada la velocidad de movimiento que constituye un importante umbral de la percepción visual. Una sucesión de fotos fijas (diapositivas) desplegadas a esa velocidad de presentación o a una velocidad próxima a ella darán la ilusión de movimiento. El cine es una secuencia de imágenes fijas alternando con trozos de película negra presentadas a una velocidad (un cuarentaiochoavo de segundo) que excede la capacidad de resolución temporal del sistema visual humano. Percibimos un movimiento suave y continuo cuando no es eso en realidad lo que se nos está mostrando. Si las moléculas vibran en torno a esa velocidad oímos algo que suena como un nota continua. Si colocaste alguna vez naipes en los radios de la rueda de tu bicicleta cuando eras niño, te demostraste a ti mismo un principio relacionado: a velocidades lentas, oyes simplemente el click-click-click de la carta golpeando los radios. Pero superada cierta velocidad, los clicks se juntan y crean un zumbido, una nota que puedes realmente tararear a compás; un tono.

Cuando se toca esa nota más baja en el piano y vibra a 27,5 hercios, para la mayoría de la gente carece del tono distintivo de los sonidos de hacia la zona media del teclado. En los extremos más bajo y más alto del teclado del piano, las notas suenan borrosas para muchas personas por lo que se refiere a su tono. Los compositores lo saben y usan esas notas o las evitan según lo que intenten conseguir desde el punto de vista compositivo y emotivo. Los sonidos con frecuencias por encima de la nota más alta del teclado del piano, en torno a los 6.000 hercios y más, suenan como un chillido de tono agudo para la mayoría de la gente. Por encima de los 20.000 hercios la mayoría de los seres humanos no oyen nada, y a los sesenta años de edad la mayoría de los adultos no pueden oír gran cosa por encima de unos 15.000 hercios, debido al anquilosamiento de las células capilares en el oído interno. Así que cuando hablamos del registro de las notas musicales, o de esa parte restringida del teclado del piano que transmite la sensación más fuerte de tono, estamos hablando aproximadamente de tres cuartas partes de las notas del teclado, entre unos 55 hercios y unos 2.000.

El tono es uno de los medios primordiales de transmitir emoción musical. Hay una serie de factores que comunican estados de ánimo, excitación, calma, amor romántico o peligro, pero el tono figura entre los más decisivos. Una sola nota aguda puede transmitir excitación, una sola nota grave, tristeza. Cuando las notas se pulsan juntas, se consiguen frases musicales más potentes y más matizadas. Las melodías están definidas por la pauta o relación de tonos sucesivos a lo largo del tiempo; la mayoría de la gente no tiene ningún problema para identificar una melodía que se interprete en una tonalidad más alta o más baja que aquella en que la oyeron anteriormente. De hecho, muchas melodías no tienen un tono inicial «correcto», flotan libres en el espacio, empezando en cualquier parte. «Cumpleaños Feliz» es un ejemplo. Así que una forma de pensar en una melodía es considerarla como un prototipo abstracto que se deriva de combinaciones específicas de tonalidad, tempo, instrumentación, etc. Una melodía es un objeto auditivo que mantiene su identidad a pesar de las transformaciones, igual que una silla mantiene su identidad aunque la traslades de un lugar a otro de la habitación, la pongas patas arriba o la pintes de rojo. De modo que si oyes, por ejemplo, una canción tocada más fuerte de lo que estás acostumbrado a oírla, sigues identificándola pese a todo como la misma canción. Lo mismo se cumple respecto a los cambios en los valores tónicos absolutos de la canción, que pueden modificarse siempre que se mantengan iguales las distancias relativas entre ellos.

El concepto de valores tónicos relativos es fácil de ver en nuestro modo de hablar. Cuando le haces a alguien una pregunta, subes espontáneamente la voz elevando la entonación al final de la frase, para indicar que estás preguntando. Pero no intentas que la elevación de la voz se atenga a un tono específico. Basta con que acabes la frase con un tono un poco más alto que como la empezaste. Esto es una convención (aunque no en todas las lenguas, es algo que se ha de aprender), y los lingüistas la conocen como una clave prosódica. Hay convenciones similares para la música escrita en la tradición occidental. Ciertas secuencias de tonos evocan calma, otras, excitación. La base cerebral de este efecto se debe primordialmente al aprendizaje, del mismo modo que aprendemos que una entonación creciente indica una pregunta. Todos tenemos una capacidad innata para aprender las distinciones lingüísticas y musicales de la cultura en la que hayamos nacido, y la experiencia con la música de esa cultura conforma nuestros canales neuronales para que acabemos interiorizando una serie de reglas comunes a esa tradición musical.

Los diferentes instrumentos utilizan partes distintas del registro de tonos disponibles. El piano es el instrumento que tiene un registro más amplio, como se puede ver en la ilustración de la página 64. Los otros instrumentos utilizan un subconjunto de los tonos disponibles, y esto influye en el uso de esos instrumentos para comunicar emoción. El flautín, con su sonido de tono agudo, estridente y como de pájaro, tiende a evocar estados de ánimo felices y despreocupados independientemente de las notas que se toquen en él. Por esa razón, los compositores tienden a utilizarlo para música feliz, o estimulante, como en la marcha de Sousa. Asimismo, Prokofiev utiliza la flauta en Pedro y el lobo para representar al pájaro, y la trompa de pistones para indicar al lobo. La individualidad de los personajes se expresa en Pedro y el lobo con los timbres de diferentes instrumentos y cada uno tiene un leitmotiv, una frase o figura melódica asociada que acompaña a la reaparición de una idea, una persona o una situación. (Es algo que se da en especial en el drama musical wagneriano.) Un compositor que elige secuencias con un tono supuestamente triste sólo se las asignaría al flautín si estuviese intentando ser irónico. Los sonidos graves y pesados de la tuba o del contrabajo suelen utilizarse para evocar solemnidad, gravedad o peso.

¿Cuántos tonos únicos hay? Como el tono procede de un continuo (las frecuencias migratorias de moléculas) hay técnicamente un número infinito de tonos: por cada par de frecuencias que menciones, siempre podrías encontrar una entre ellas, y teóricamente existiría un tono distinto. Pero no todos los cambios de frecuencia producen una diferencia de tono apreciable, lo mismo que añadir un grano de arena a tu mochila no cambia perceptiblemente su peso. Así que no todos los cambios de frecuencia tienen utilidad musical. No todos tenemos la misma capacidad para detectar pequeños cambios de frecuencia; la formación puede ayudar, pero hablando en términos generales, la mayoría de las culturas no utilizan distancias mucho más pequeñas que un semitono como base de su música, y la mayoría de las personas no pueden percibir de modo fidedigno cambios más pequeños que aproximadamente una décima de semitono.

La capacidad para apreciar diferencias de tono depende de la fisiología, y varía de un animal a otro. La membrana basilar del oído interno humano tiene células capilares selectivas respecto a la frecuencia que sólo se activan con una gama de frecuencias determinada. Están distribuidas a lo largo de la membrana siguiendo un orden que va de frecuencias bajas a altas; los sonidos de frecuencia baja excitan las células capilares de un extremo de la membrana basilar, los de frecuencia media excitan las de la zona media y los de alta frecuencia, las del otro extremo. Podemos imaginar que la membrana contiene un mapa de tonos diferentes muy parecido al teclado de un piano colocado sobre ella. Como los diferentes tonos están extendidos por la topografía superficial de la membrana, a eso se le llama un mapa tonotópico.